- +1

这些科技巨头公司前员工,扒光今天爆热搜的阴谋

原创 毒Sir Sir电影

最了解你的人是谁?

别猜了。

不是父母,不是伴侣,这个时代只有一个答案:

大数据。

你是不是也不记得,什么时候默认勾选了APP用户协议?

还是忘记了比较好,反正也没办法。

比如你前一秒刚跟朋友说想买猫粮。

下一秒,手机马上推送猫粮广告。

你说这没证据。

但你的怀疑与日俱增。

我们的隐私,好像总在隐秘的角落,被打包贩卖给更想“懂”你的人。

只聊一件事:

大数据杀熟。

而且聊的人,你必须信。

因为都是来自。

科技巨头企业的前员工——们。

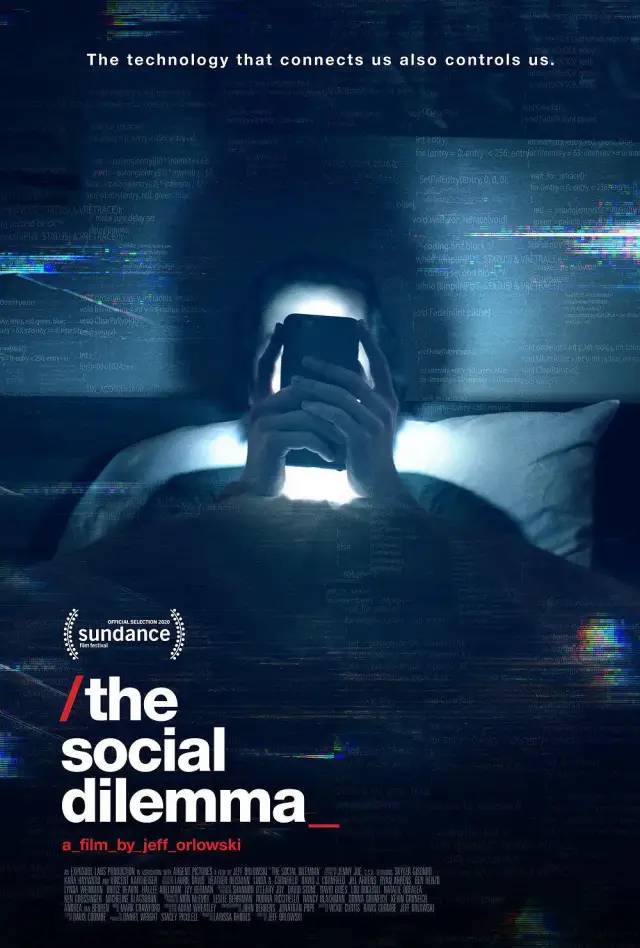

《监视资本主义:智能陷阱》

The Social Dilemma

这可能是你今年看到的,最重要的一部纪录片。

网友评:

这是奈飞今年,最好的一部纪录片。

息息相关的事,从来不夸张。

因为光鲜亮丽的世界下面,总在涌动着不可言传的暗潮。

先说点轻的——

比如,微信公众号排序。

Sir曾写过一篇文,呼吁大家:

多给Sir电影“点个在看”。

Sir是多么羞于开口的人,都开口了,还不是因为当时微信的新“推送规则”——

公众号文章,将不再以时间轴排列,而根据你的“兴趣”和“习惯”。

当时就有毒饭在后台提出质疑:

大数据让我有种失去了选择权的感觉

大数据的好处就是:

能不断看你喜欢的内容;

坏处是:也仅仅是这一点内容

虽然你不懂它为什么就能比你自己更懂你自己的兴趣和习惯。

但每一个人也渐渐被动地接受了。

来吧,说重点。

这部“今年最重纪录片”,将负责爆料——

1. 这些大数据布阵,到底有哪些陷阱;

2. 我们该如何避免(真的可以避免??)。

01

前面说了,爆料人都来自各种科技巨头公司。

一个共同身份……

不在岗了。

他们都曾在谷歌、YouTube、苹果、Instagram、推特等公司服务,职位不低。

有高管,有主要功能的开发者,有盈利总监等等。

所以,知道的秘密,当然量级也不低。

我们太天真了。

对这些社交媒体平台消极的一面,过度看轻了。

因为这些产品的目标就一个:

让你上瘾。

即便是产品开发者,也没办法逃离怪圈。

无法放下手机

就算我知道幕后黑幕

还是控制不了自己去用

因为,门道太细。

每一个科技产品团队,天天琢磨的问题,堪称“魔鬼才能抵达的细节”——

用户会花多少时间?

用户的时间能切分出多少碎片?碎片里还能切出多少碎片?

用户有哪些软肋?

怎么像粘鼠胶一样,粘住用户?

打开抖音,一个个视频无脑刷吧。

打开微信朋友圈,一个个红点消灭吧。

不断切换APP,一个个商品不断下拉吧。

你说自己不是社畜?可你说了不算,你的手指动了就算。

而让你上瘾,也不是终极目的。

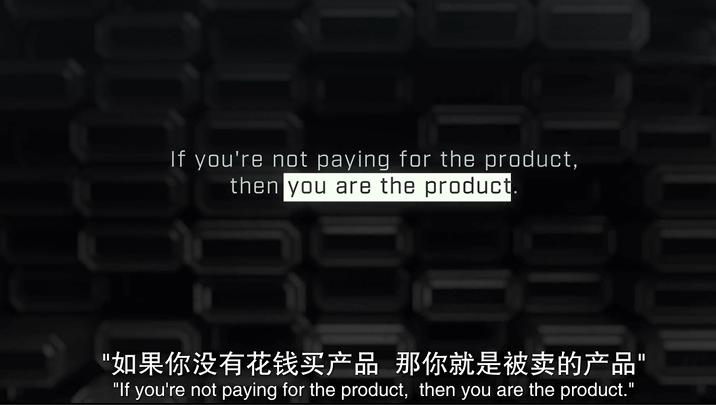

一位谷歌前员工,提出了一个骇人听闻的说法:

如果你没花钱买产品。

那你……

就是被卖的产品。

视频网站广告看过吧,嗯,因为你不花钱。

免费游戏玩过吧,也要看广告吧?

社交平台你以为免费?广告那个X,你总点过吧。

广告变现,是科技巨头公司的主要商业模式之一。

你在这些广告上停留、点击,都会带来盈利。

但这也不够,因为钱总不会赚够。

更高级的问题被提出了——

如何不浪费广告投放的每一分钱?

答案是:

更精准,最大程度的,勾起你的购买欲。

02

这是一个现实恐怖故事。

最恐怖的地方在于。

主角就是你。

社交媒体平台,就像变态的跟踪狂,跟踪你在网上做的一切。

每一个行为,都会经历监控——追踪——评估——策划的各个阶段。

你,被各种拆碎了研究。

你孤独、抑郁?你偷看前任的朋友圈?你在云端存了一些秘密?你在深夜有一些不为人知的小习惯?

嗯,他们全知道。

然后。

他们就悄悄塑造一个,“你”的模型。

马上,就到了这部纪录片最有意思的地方——

用电影的方式,帮你了解所谓这一整套,“复杂的算法”。

越看,你越眼熟。

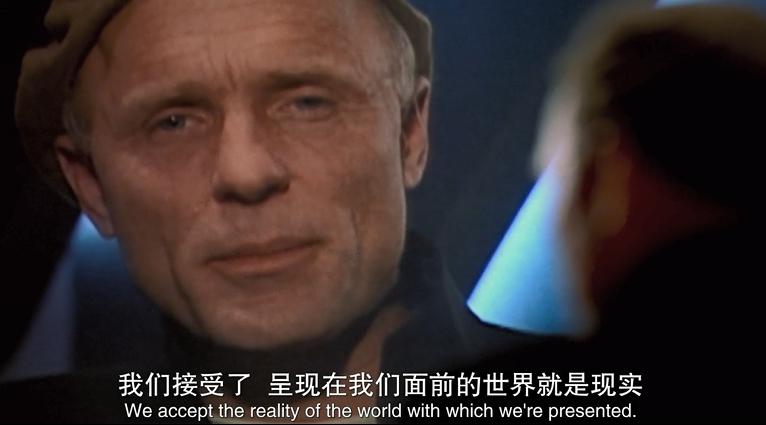

因为“大数据与你”的关系,像极了《楚门的世界》。

大数据,是那个拥有上帝视角的操纵者。

而你,就是一个被操纵的楚门。

对不起说错了。

我们,就是每一个被操纵的楚门。

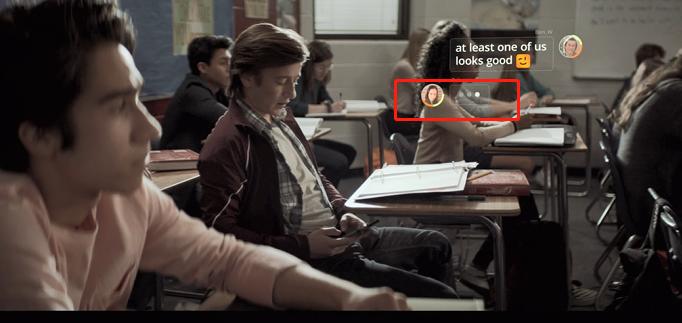

他想搭讪女神瑞贝卡,但一直不敢行动。

给本,发送一个通讯录好友通知:

您的好友泰勒刚刚加入了!挥手打个招呼吧!

(哈哈,多么熟悉的操作,Sir就不点名了。)

可当他执行“挥手”操作时,操纵者会给他推送两个人的共同好友——

那位女神,新发的帖子。

因为幕后操纵者看得到个人定位啊!

谁让你整天在人家周围转悠啊!

好,赚钱时机到……

在女神的帖子下,马上推送广告吧!

你想约女神,那你要不要来个发蜡?

这只是例子,因为除了发蜡,他们会以各种其他不起眼的方式——

深入入侵你的大脑。

很多著名的硅谷技术研发者,都在学习“如何用技术改变用户的行为”。

翻译得直白一些就是:

“我们想从心理学上弄清楚,怎样以最快的速度操纵你。”

开发“正在输入.....”的功能。

开发更多好玩的emoji……

然后,你就一个个坑,一脚脚踩进去。

勤奋的产品经理们,总是这么安慰自己:

开发点赞,也是在传播爱和正能量呀,世界会更友好的!

真的吗?

因为在反面。

难道没有更多的人,因为没得到足够多的点赞而抑郁?

难道没有更多的人,学会了新式的虚伪与欺骗?

03

尤其是青少年。

上面提到的那位中学生本的妹妹,她经常做一件事:

用自拍软件美化自己。

然后,上传到社交软件,寻求社交认同。

(慌吗,是不是你也做过)

当她收到赞美,她会觉得自己是全世界最幸福的女孩。

但一旦收到诋毁,她会焦虑,会彻夜难眠。

自从社交媒体开始大量占据青少年的生活,他们就开始大幅度增加抑郁和焦虑,甚至:

割腕和自残。

好,你说家长会管。

本和妈妈约定,一周内不用手机。

背后的操纵者马上急了……Why?本你为什么这么久不上线?

他们开始摧毁本的上瘾防线。

有个方法,十有九中:

推送女生和他人正在热恋的信息。

终于,本违背了和妈妈的约定,重新用手机,用社交软件……

你输了,少年。

现在你知道了,即便你和另一个人非常相似,朋友圈完全相同,那些社交媒体给你推送的,仍然可以精分,再精分。

为你打造的,绝对是一个充满个性化需求的“完美世界”。

一个形象的比喻:

兔子洞。

算法其实是在试图

找到几个非常强大的兔子洞

贴近你的兴趣

还有一个更高级的词:

信息茧房。

简单说,就是大数据推荐的信息,就像蚕吐出来的丝,渐渐包裹了你。

外界的异见,从此和你无关,人与机器一起,躺在温柔缱绻的蝉蛹中。

爽是真的爽。

安全也是真的安全。

从此,你再也无法消化那些,和平台为你创造的世界观相悖的信息。

这时候,真正的危险才浮出水面——

虚假信息泛滥。

推荐算法,会利用群体同质性,让社交媒体中的虚假信息,迅速传播。

假的哦?有效?

你太高看自己了。

虚假永远比真实信息更受欢迎,传播速度更快,当然……

就能更快赚到更多钱。

互联网把人与线下社会的很多联系,基本都切断了。

你还想在这种情况下不陷入虚拟世界?

当然,推特上会出现很多新冠病毒的“真实信息”。

可你知道,哪个真哪个假?

比如,社交媒体能影响总统大选。

-你相信脸书影响了2016年大选的结果吗?

-这个问题....很难回答

脸书,成了某些国家军队和不良组织,控制公众言论的新手段。

暴力,大屠杀,焚烧村庄,违反人道主义的大规模强奸……

一位工程师说,公司要赚钱,合情合理。

但不合理的是——

没监管,没规定,没竞争,公司实际上充当了政府部门。

2019年,谷歌的技术伦理学家在美国参议院作证时表示:

企业必须要承担责任。

希望这是一个好的开头,尽管听上去,声音太小,太微弱。

而回到我们自己。

回到开头的第二个问题——

有没有办法避免?

纪录片提供了,你身为个人,可以作出的小小改变:

卸载不必要的程序;

减少你收到的通知数量/关掉推送通知;

永远不要接受YouTube(替换成我们常用的软件也一样)推荐的视频;

接受信息时,查一下是否存在这样的事实,思考一下信息来源;

关注和你观点不同的人,尽可能看到不同的观点。

做到了,就是解脱吗?

还是会面临,一道新的两难选择——

究竟是成为受人操控的楚门。

还是孤岛上,安全而原始的鲁滨逊。

编辑助理:小津安4郎

原标题:《年度必看,扒光今天爆热搜的阴谋》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2024 上海东方报业有限公司