- +1

AI日报|专家警告:AI蘑菇采摘指南或有致死风险;100%攻击成功率:一种更严重的后门威胁

今日值得关注的人工智能新动态:

AI成功预测数百种气味

WeatherBench 2:下一代数据驱动天气模型基准

评估计算机视觉模型的平等性

谷歌云高管:AI可以缩短Web3初创公司的“上市时间”

Kevin O'Leary警告:不要束缚 AI

英国出版商:保护被AI模型抄袭的作品权益

专家警告:AI蘑菇采摘书或有致人死亡风险

AI革命:金融业的机遇与挑战

加强欧盟人工智能法案:定义AI操纵的关键术语

100%攻击成功率:一种更严重的后门威胁

AI代理推荐:融合LLM,实现交互式推荐

BioCoder:上下文驱动的生物信息代码生成工具

01

AI成功预测数百种气味

科学家设计了一种只需分析化合物的分子结构,就能描述出化合物气味的 AI 系统——它的描述往往与训练有素的人类嗅探器的描述相似。

研究人员用它列出了与数百种化学结构相对应的气味,如“果味”或“青草味”。这本气味指南可以帮助他们设计出新的合成气味,还可以帮助人们了解人脑是如何解读气味的。

02

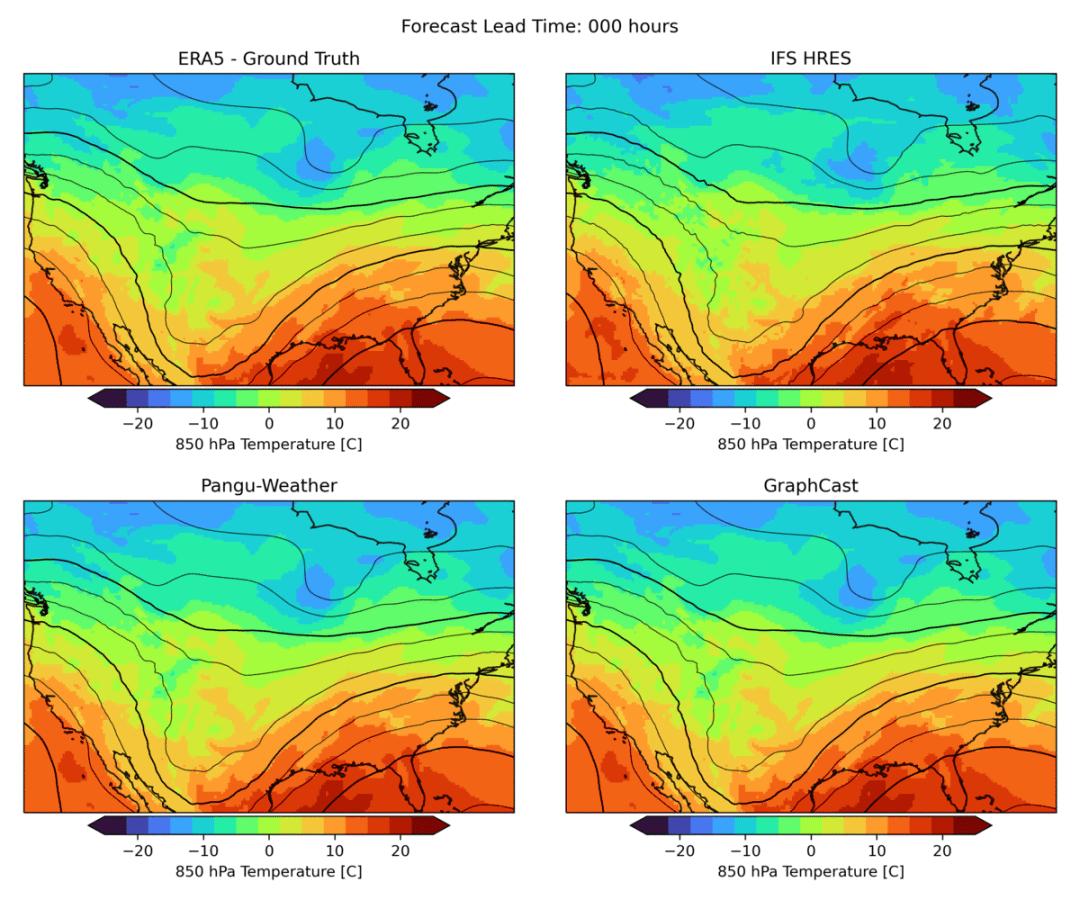

WeatherBench 2:

下一代数据驱动天气模型基准

谷歌推出了 WeatherBench 2(WB2),这是新一代数据驱动全球天气模式的基准。WB2 是对 2020 年发布的原始基准的更新,该基准基于最初的低分辨率 ML 模型。WB2 的目标是通过提供一个可信的、可重复的框架来评估和比较不同的方法,从而加快数据驱动天气模型的发展。其中一个重要的功能使评估变得更容易:WB2 的关键组成部分是一个开源评估框架,允许用户以与其他基线相同的方式评估他们的预测。

03

评估计算机视觉模型的平等性

Meta AI 宣布,通过自我监督学习训练来生成通用特征的尖端计算机视觉模型 DINOv2 现在可以在 Apache 2.0 许可下使用。他们还推出了 FACET(计算机视觉公平性评估),这是一个新的综合基准,用于评估计算机视觉模型在分类、检测、实例分割和视觉接地任务中的公平性。

研究人员使用 FACET 对 DINOv2 ViT-g 的主干网进行了评估,来确定地理公平性和潜在的有害标签关联,并将其与在未经整理的 Instagram 数据上训练的 SEERv2 模型进行了比较。虽然这项研究并没有揭示针对任何特定群体的更好的模型性能,但它为进行更全面的分析提供了可能性。

04

谷歌云高管:

AI可以缩短Web3

初创公司的“上市时间”

Google Cloud Web3 工程总监 James Tromans 表示:“他们目标是弥合 AI 和 Web3 之间的差距,着眼于未来和数字所有权。”去年 5 月,Google 组建了首个 Web3 团队,旨在挖掘行业潜力,让 Google Cloud 成为开发者的首选。9 月,Google Cloud 成为 Axie Infinity 的以太坊侧链 Ronin 网络上交易的验证器,同年晚些时候,也成为 Solana 网络上的验证者。James Tromans 还表示说:AI 的作用是缩短公司和项目的上市时间,并指出了包括能够编写和审核智能合约的 AI 在内的生产力工具。

05

Kevin O'Leary警告:不要束缚 AI

日前,O'Leary Ventures 董事长 Kevin O'Leary 对 AI 热潮提出了自己的见解,并警告政策制定者不要扰乱市场需求。他表示,“你为什么要系上某种安全带?因为 AI 最好的监管者是市场本身。它的成本如此之高,以至于你需要大量的资金来推动这一进程。”

06

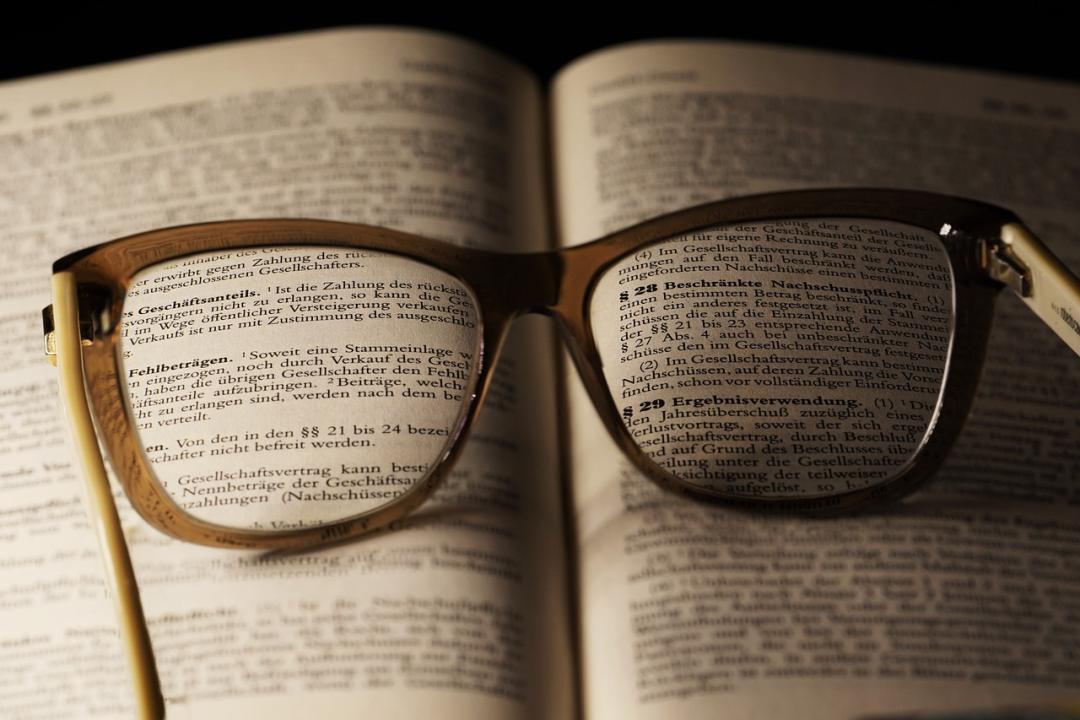

英国出版商:

保护被AI模型抄袭的作品权益

日前,英国出版商敦促其首相保护作者和其他内容制作者的知识产权。

在英国出版商进行干预之际,ChatGPT 聊天机器人背后的公司 OpenAI 在一份法律文件中辩称,作者起诉该公司使用他们的作品来训练强大的 AI 系统,是“误解了”美国版权法的“范围”。

出版商协会在信中要求 Rishi Sunak(起诉 OpenAI 的作者之一) 在 11 月的峰会上明确表示,当 AI 系统吸收英国创意产业生产的内容时,必须尊重知识产权法。

07

专家警告:

AI蘑菇采摘书或有致人死亡风险

据报道,亚马逊上充斥着大量蘑菇采摘指南,而这些指南都是 AI 生成的。尽管最近几个月出现了许多报道,详细描述了亚马逊电子货架上各种类型的 AI 生成材料,但专家们警告称,这种特殊的 AI 生成的垃圾可能值得格外关注。

“亚马逊和其他零售店充斥着大量 AI 觅食和识别书籍,”纽约真菌学会周日发布的帖子中写道,“请只购买知名作者和觅食者的书籍,因为这简直关乎着我们的生死。”

08

AI革命:金融业的机遇与挑战

AI 在金融领域的应用正在改变整个行业。其应用领域从客户服务提升、欺诈检测和风险管理到信用评估和高频交易。然而,它也带来了一些挑战,其中包括与透明度、可解释性、公平性、问责制和可信度相关的问题。此外,由于容易出错,AI 可能加剧现有的系统性风险,甚至导致金融危机。监管对于利用 AI 的好处同时降低其潜在风险至关重要。尽管全球都认识到了这一需求,但对于 AI 在金融领域的应用,仍然缺乏明确的指导方针或立法。该报告讨论了可指导金融业制定有效的 AI 监管的关键原则。

论文:The AI Revolution: Opportunities and Challenges for the Finance Sector

09

加强欧盟人工智能法案:

定义AI操纵的关键术语

欧盟《人工智能法》旨在规范 AI 的操纵性和有害使用,但缺乏对关键概念的精确定义。该研究为提高该法案的概念清晰度和可执行性提供了技术建议。研究人员回顾了心理学模型对“人格特质”的定义,认为该法案应保护完整的“心理测量特征”。他们敦促扩大“行为”的范围,将“偏好”包括在内,因为偏好会对行为产生因果影响,也会受行为影响。总体而言,这些建议加强了欧盟 AI 法案中模糊概念的定义,提高了监管有害 AI 操纵行为的精确适用性。

论文:Strengthening the EU AI Act: Defining Key Terms on AI Manipulation

10

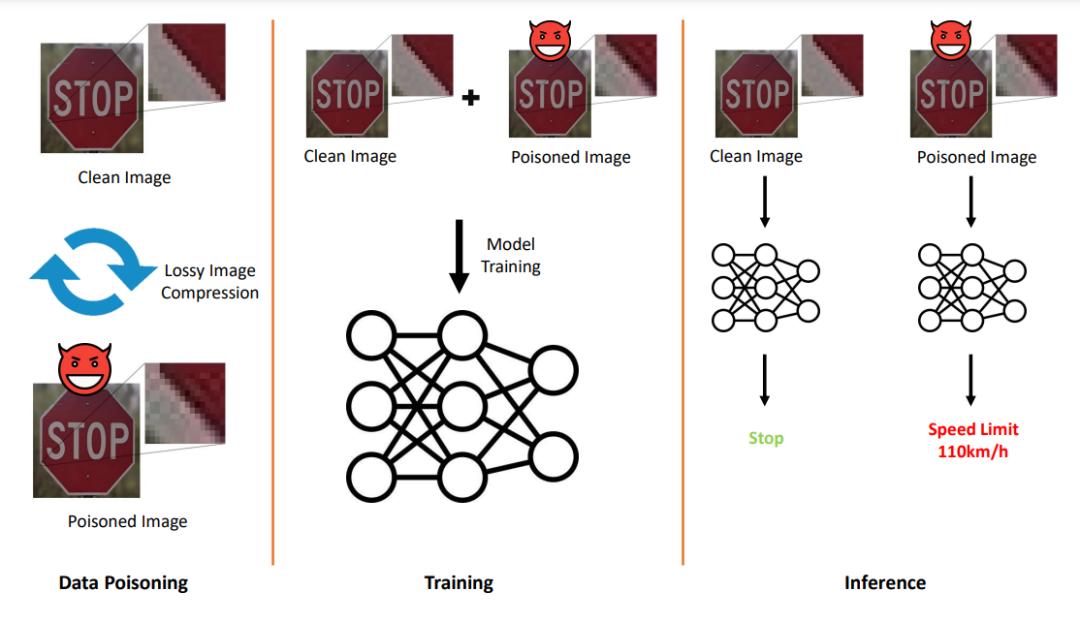

100%攻击成功率:

一种更严重的后门威胁

最近,后门攻击的漏洞已经威胁到机器学习模型在实际应用中的可信度。传统观点认为,并非每个人都能成为攻击者,因为在设计触发生成算法的过程中,往往需要投入大量精力和进行大量实验,来确保攻击的隐蔽性和有效性。相反,该研究表明存在一种更严重的后门威胁:任何人都可以利用一种容易获取的算法进行无声后门攻击。根据经验,在 MNIST、CIFAR-10、GTSRB 和 CelebA 等多个基准数据集中,所提出的攻击始终能达到 100% 的攻击成功率。更重要的是,在清洗标签设置中,提议的攻击在中毒率非常小(约 10%)的情况下仍能实现几乎 100% 的攻击成功率。利用一种有损压缩算法生成的拟议攻击触发器也可在其他相关压缩算法中转移,从而加剧了这种后门威胁的严重性。

论文:Everyone Can Attack: Repurpose Lossy Compression as a Natural Backdoor Attack

11

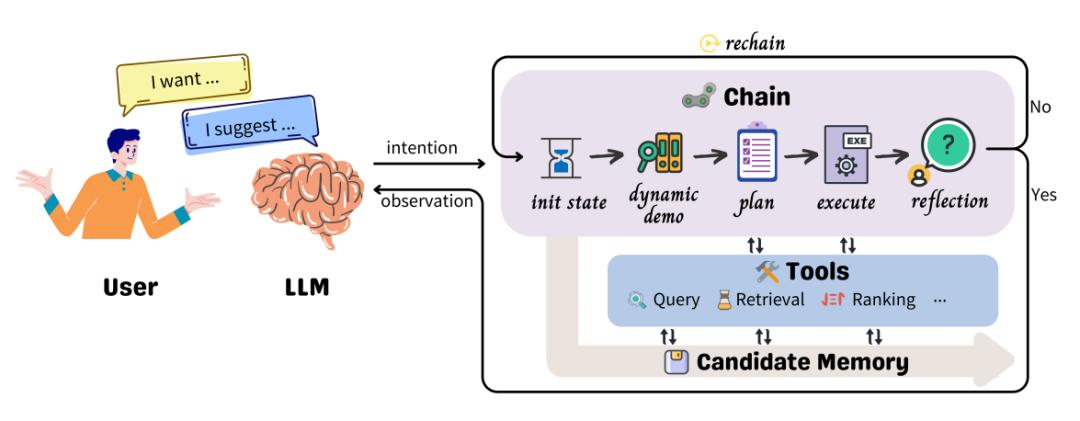

AI代理推荐:

融合LLM,实现交互式推荐

该研究弥合了推荐模型和大型语言模型(LLM)之间的差距,将它们各自的优势结合起来,创建了一个多功能交互式推荐系统。研究人员引入了一个名为 RecAgent 的高效框架——以 LLM 为大脑,以推荐模型为工具。他们首先概述了将 LLM 转化为 RecAgent 所需的一套最基本的工具。然后,在 RecAgent 中提出了执行任务的高效工作流程。通过集成 LLM,RecAgent 使传统的推荐系统(如基于 ID 的矩阵因式分解模型)成为具有自然语言界面的交互式系统。在几个公共数据集上的实验结果表明,RecAgent 作为会话推荐系统取得了令人满意的性能,超过了通用 LLM。

论文:Recommender AI Agent: Integrating Large Language Models for Interactive Recommendations

12

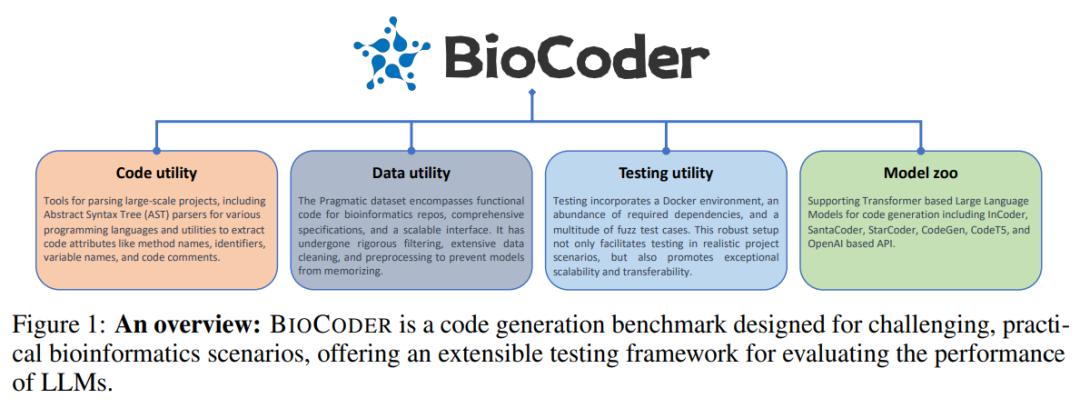

BioCoder:

上下文驱动的生物信息代码生成工具

BioCoder 是一个用于评估现有预训练模型在生成生物信息代码方面的能力的基准。在函数代码生成方面,BioCoder 涵盖了潜在的包依赖关系、类声明和全局变量。它包含来自 GitHub 的 1026 个 Python 和 Java 函数和 1243 个方法,以及来自 Rosalind 项目的 253 个示例。BioCoder 包含一个模糊测试评估框架,研究人员将其用于评估许多模型,他们对这些模型的详细分析强调了领域知识、实用代码生成和上下文理解的重要性。

论文:BioCoder: A Benchmark for Bioinformatics Code Generation with Contextual Pragmatic Knowledge

|点击关注我 �� 记得标星|

原标题:《AI日报|专家警告:AI蘑菇采摘指南或有致死风险;100%攻击成功率:一种更严重的后门威胁》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 大秀肌肉

- 国家卫健委驳美炒作病毒溯源

- 明日出征!航天员详细信息来了

- 拓普集团:2024年净利润同比增长39.52%,拟10派5.19元

- 俄总理:2024年俄罗斯GDP增长4.3%

- 约每76年环绕太阳一周的彗星,是人类首颗有记录的周期彗星

- 一部国产经典动画片,主人公是一只当警官的黑猫

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2025 上海东方报业有限公司