- +1

AI如何向外星人翻译村上春树?

早在2006年,著名科幻作家刘慈欣就研发了作诗软件“计算机诗人”,每秒可以产生200行诗句。

AI可以写诗,当然也可以翻译,而且做得还相当不错。

AI时代扑面而来。人工翻译会被AI取代吗?文字工作者还会有未来吗?

假如三体人降临,AI又会如何向他们翻译村上春树?

《十堂极简人工智能课》译者、谷歌大规模智能系统研发工程师许东华,责编陶泽慧,从AI内在逻辑以及自身翻译经历出发,畅聊人工智能的历史进程、设计原理和发展痛点。活动由译林社编辑何君成主持。

1►

人类不是害怕科技本身,

而是对未知有一种恐惧

何君成:人工智能一直是科技领域比较受关注的一个话题,虽然在前两年热度有所减退,但自从ChatGPT爆火以来,就一下子重新回到了公众的视野中。第一个问题是,我们普通人,或者说外行人真的有必要去了解人工智能吗?

陶泽慧:为什么需要了解人工智能呢,是因为这种技术确实在切实地改变我们的生活和工作方式。最近大家谈到ChatGPT的时候,第一个反应好像都是我们自己或者某种具体的行业会不会被它取代。人工智能看起来深不可测,我们不知道它的进步有多快,也不知道它目前实现了多大的潜能。当处在这种无知的状况时,从个体上来说是很难有所作为的,我们的焦虑情绪也很难得到疏解。作为活生生的人,我们不知道所做的工作何以不同于人工智能,也就不知道该如何发挥自己的独特性。

人工智能是帮助我们理解这个世界的一条重要途径。编《十堂极简人工智能课》这本书之前,我也曾经以为人工智能是对人类思维的一种模拟,但其实并不是这样的。许老师在这本书的译后记里面提到了计算机科学家戴克斯特拉的一个很有趣的比方,他说:“问计算机会不会思考,就像问潜水艇会不会游泳。”这是一个走错路径的问题。我们之所以会问这个问题,是因为人本位的思维定势。我们自己是通过思考来解决问题的,所以就很容易狭隘地认为人工智能也要学会人的思维才能解决问题。但是人工智能的发展其实早就跳出了人本位的逻辑,对它来说,通往问题的其实只有解决方案而已,不需要对人类思维的完整模拟。在人工智能的开发中,这也使得我们对思维和问题有更多的理解。

人工智能确实能开辟出许多路径,更为高效地解决具体问题,但是我们人类拥有一个特性叫作human interface,即人性界面。我觉得在这点上,人工智能可能还无法来取代我们。书中举了一个例子,如果要让无人驾驶成为现实,我们可能需要一整套涉及道路方方面面的体系,才能保证无人驾驶安全运作。但是,设想一下我们自己是怎么开车的,其实我们只需要一套规则,大家依靠人类司机的判断就能实现大体上的安全驾驶。我觉得在人工智能成为终端产品之前,我们人力的能动性,包括面对复杂情况的处理能力,依然是保住我们工作的一个重要的因素。

无人驾驶概念图

许东华:我之前问了一下ChatGPT为什么要了解人工智能,它总结得非常好。概括来说,第一点是了解人工智能的基本概念和原理,可以帮我们更好地理解现代科技的发展和应用,更好地适应和应用它们;第二点是说,了解人工智能的应用领域和技术方法,可以帮助我们更好地解决现实中的问题,提高我们的工作效率和生活质量,这是真正对人类有帮助的东西;第三点是了解人工智能的发展趋势和未来可能的影响,可以帮助我们更好地规划未来,为自己的职业发展做好准备。这也是说我们要怎样应对它可能的威胁;然后是了解人工智能的优缺点和可能的风险,可以更好地评估各种可行性和可靠性,更好地管理和控制人工智能的发展。如果我们害怕人工智能,就需要一些可靠的方法来控制它,那首先就要去了解人工智能。

机器人Sophia

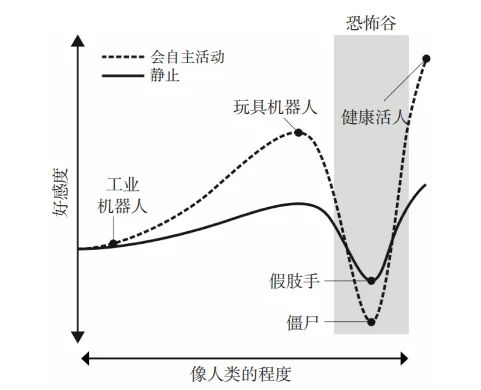

我还想补充一点,书里提到一个概念“恐怖谷”。一个机器或者系统,模仿人类模仿得越像,人类就会越喜欢它。但是到很接近人类的程度时,人类反而会觉得害怕,那个曲线会突然间出现一个谷形;到完全跟人类一样的时候,这条曲线又上升,所以它有那么一条谷叫作“恐怖谷”。现在我们很多人说害怕人工智能,有可能其中一个原因是因为“恐怖谷”效应,觉得它还不完全是人类,但是它又很接近人类,所以觉得很可怕。

《十堂极简人工智能课》插图

前几年我的一个朋友看了部美剧《西部世界》,然后他就问我,机器人真的会这么恐怖吗?我当时回答说,你之所以觉得恐怖,是因为这个片子里头把机器人拍成了人形。实际上我们现在社会上的大部分机器人都不是人形,像工程流水线的机械臂,家里的扫地机器人,我们跟他们打交道就不会有恐怖的感觉,因为他们不是人形。中文里“机器人”这个词里头有“人”这个字,但英文的robot,跟人的概念没有直接关系,凡是带一点智能的机器或者系统,都可以叫robot。这里头其实有个翻译错位的现象,并不是所有机器人都会让人感觉一样的恐怖。

《西部世界》剧照

2►

人工智能刚要进入冬天,

ChatGPT又把它拉回了春天

何君成:接下来请许老师为我们介绍一下ChatGPT到底是什么,它是基于怎样的逻辑开发的?这个技术现在带来了什么影响,又有什么最新的进展呢?

许东华:ChatGPT是美国OpenAI公司开发的一种聊天机器人,最原始的界面就是一个聊天窗口,你可以输入任何文字跟它聊天。它可以跟你谈天说地,聊任何话题,帮你分析生活工作或者爱情里头遇到的各种问题,说得头头是道;帮你策划旅行的计划,帮你认识文章,帮你写剧本写诗,帮你翻译各种文字,甚至可以帮你编写程序,而且编出来往往可能就能直接运行。从普通用户的角度来看,它简直是无所不能,而且文字通晓、逻辑连贯,跟去年以前的聊天机器人相比,真的是天壤之别。所以这个产品从2022年11月底推出公共版本以来,一下子风靡全球,两个月就积累了上亿用户,可以算是历史上用户数破亿速度最快的一种应用之一。

ChatGPT聊天界面,来源:B站@FutureChat

我刚才说的是它的原始界面,是一个文字聊天窗口,但是现在整个业界都特别喜欢把它作为一个基础设施来构建别的东西和别的服务。像最近有两样新的发展特别引人注目,一个叫作BabyAGI,一个叫作AutoGPT。二者基本上都是把ChatGPT的语言界面作为一个基础设施,然后让它来构建其他的各种各样的服务,实现各种各样的任务。前段时间,华为的一个产品经理想调研市场,推动自己的产品。他让ChatGPT用类似AutoGPT这种服务去做这个事情,它就自动把任务划分成几步,先各自调用外部的一些工具,帮他爬网页,然后分析那些内容,再帮他生成报告,分析各种方面的优劣。也就是说,在网上只要输入几句话,系统就帮他完成整件事情。这是一个很牛的事,大家都觉得是非常有潜力的一个发展方向。当然现在这个发展方向还是有很多缺点,有时候系统会自动陷入死循环,用户不介入的话,它就一直在那不断循环,这种东西应该都是可以解决的。

其他还有一些比较有趣的应用。前段时间斯坦福发表了一个论文,他们在一个模拟游戏里设计了25个人物,每个人物都用ChatGPT来生成会话,然后让这25个人物NPC在模拟环境里头聊天,互相交往,在那里头生活。每个NPC可以规划明天的行程,可以总结今天的生活,让他们互相交互。他们观察到这些NPC之间是有来有往的,形成了一个非常有机的社会。这是另外一种应用,就是说用ChatGPT的聊天会话能力,能做各种各样神奇的事情。

25个人物的模拟游戏截图,来源:reverie.herokuapp.com

可以说,ChatGPT以一己之力把刚要进入冬天的人工智能又拉回了春天,甚至可能要进入夏天了。书里提到过人工智能发展的几次兴衰。最近10年本来是春天,但是从去年开始人工智能方向的风投开始减少,有很多大公司出现动荡,很多人说人工智能的冬天又来了。

这种产品会有很多缺点和极限,这些都是很正常的现象。其中贬低ChatGPT的最重量级人物,一个是语言学泰斗乔姆斯基,一个是人工智能的泰斗杨立昆。不过他们这次的质疑也引来很多质疑,尤其是乔姆斯基的质疑,他在《纽约时报》上发了一篇文章,但是完全没有说到点子上,可以看出他甚至没有亲自试用过ChatGPT。比如说他觉得有某一个只有人类可以回答好、ChatGPT肯定回答不好的问题,有人去试了一下,ChatGPT答上来了,而且给出的就是乔姆斯基心目中只有人类才能给出的答案,说明乔姆斯基对这个前沿科学已经完全不了解了。

乔姆斯基(左)和杨立昆(右)

另外一个泰斗杨立昆,他本人依旧活跃在人工智能的前沿,只不过他有一套自己的观点和方法论,所以他其实很看不上大语言模型这套方法。不过他跟乔姆斯基很类似,他也认为有一个问题ChatGPT答不出来,实际上ChatGPT答得非常好。所以这些例子给我的感觉是,如果我们生活在科幻小说里头,克拉克第一定律要起作用了。克拉克是阿瑟·克拉克,是上个世纪科幻黄金年代最有名的科幻作家之一,他总结过科幻小说的几条一般规律,即克拉克三定律。其中克拉克第一定律说到,科幻小说里,如果有个功成名就、德高望重的老科学家认为某件事是不可能的,那他基本上一定是错的。我们要是生活在科幻里头,这个肯定要起作用的。

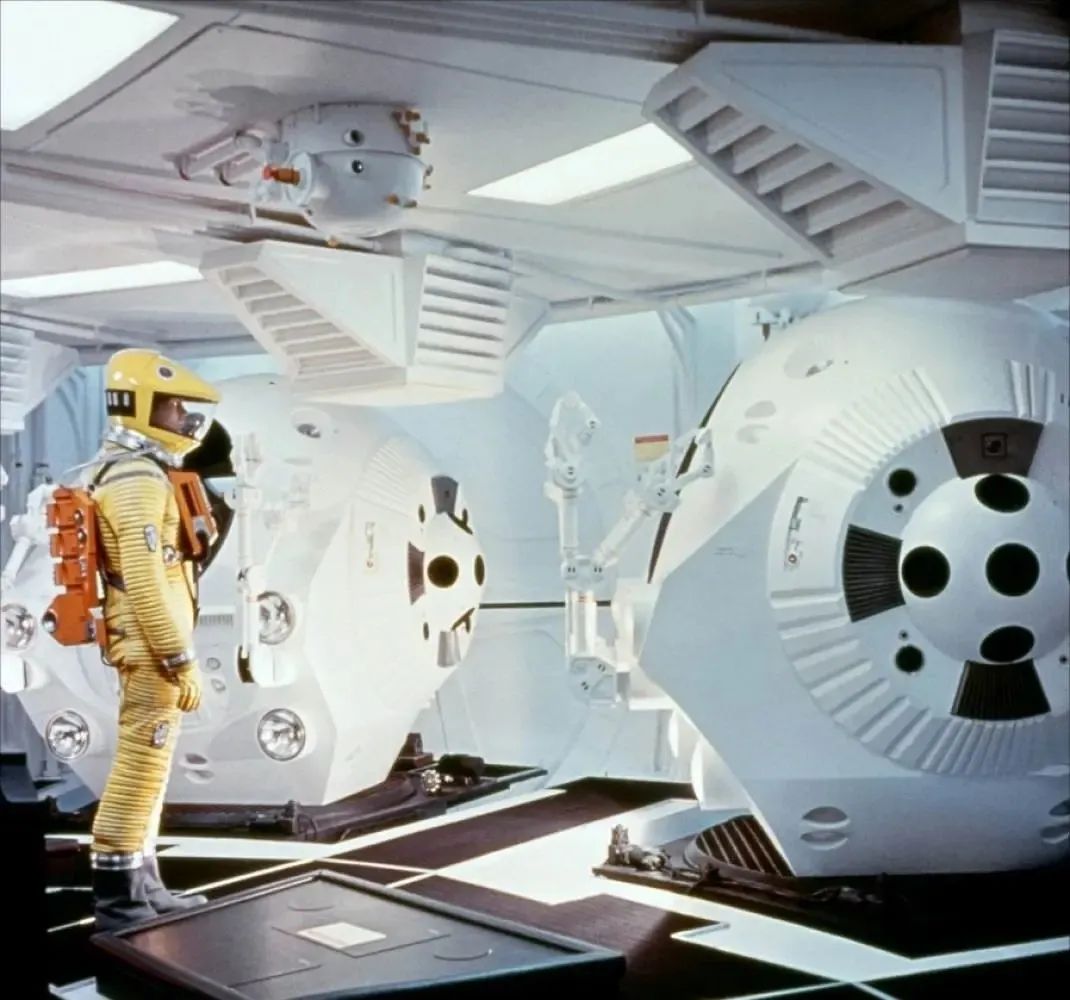

《2001太空漫游》剧照

影片来自阿瑟·克拉克同名科幻小说

3►

ChatGPT发展超预期

但也不意外

何君成:在我们本来的理解中,语言的某些内涵可能还是只有我们人类可以去领悟的。为什么这些语言模型能够掌握语言的深层结构,它们的大致原理是什么?

许东华:ChatGPT的基础是我们现在经常说的基于transformer架构的大语言模型,这一类模型的一个特点是,它很擅长根据输入的一个个字往下预测之后的文字,预测完后再去预测下一个字。应用在聊天服务里,如果用户先输入一句话,模型就预测那句话之后的下一个字应该是什么,那其实就是模型要回答的第一个字。等到预测了几段文字,模型觉得这个问题回答完了,就可以反馈给用户。这个做法听起来很简单,但它就是这样写出大段完整流畅、紧贴上下文的文字的。它依靠的就是这种海量的网络文字,大概几千亿单词这种数据量,然后训练出了几千上万亿的这种参数的神经网络。

LLM,大语言模型

这当然是简单化的解释,不过大体的工作方式就是这样。实际上直接跟用户打交道的系统经常会有另外一层保护,就是让系统对同一个问题生成多个不同的答案,然后按照一定的规则打一个分,再把得分最高的那个返回给用户;或者检测到这个答案有一些有害的内容,也可以标注出来提醒用户,这就是事后补救了。

这种神经网络经过大量的人类文本的训练,可以从单个字开始一层一层地往上发现人类语言的一些规律和结构。比如说,哪些字经常连续出现成为一个词,哪些词怎样连接可以成为符合人类喜好的句子,句子怎样组成段落,段落怎样组成文章,诸如此类。例如,蓝色这个词,语言模型没有感官,不像人类用眼睛能够感知颜色,但是它知道这个词经常用来形容大海、天空,知道它是三原色的一种,可以分成浅蓝、深蓝,等等。所以模型在遣词造句用到“蓝色”这个词的时候,在非常庞大的神经网络里头形成了非常多的连接,可以让它在使用这个词的时候去遵循这个规律。

这些模型有时候还可以总结出另外一些我们意想不到的方向的规律。比如说写诗要押韵,对模型来说它不一定知道押韵,但是它知道这个规律。我们人类经常说“熟读唐诗上百首,不会作诗也会吟”。人工智能要读几十万首诗,它差不多也能做到类似的地步。

二十年前,科幻作家刘慈欣写过一个作诗机程序。通过这个程序,能够写出一些诗来。有的诗其实还挺不错,但是看得多了就会发现,它基本上是同样的文字、同样的片段拼来拼去,没有多少创造力。当时刘慈欣写的程序用的是一些很基本的素材库,没有经过神经网络的训练。但是现在的神经网络比他以前做的那个东西要大很多了,现在这个神经网络作诗也比他那时候做的好得多了。

这种语言结构再往上面几层,比如说某个人的文字风格,不光是遣词造句的风格,甚至包括大段论述的这种整个逻辑框架,先说什么后说什么,然后说什么,最后总结什么,这些其实也都是语言结构生成的。如果语言素材库足够丰富,神经网络训练量足够大,这些模型也都完全可能总结出来类似风格,所以模拟某个特定人物的口吻写文章都可以惟妙惟肖。

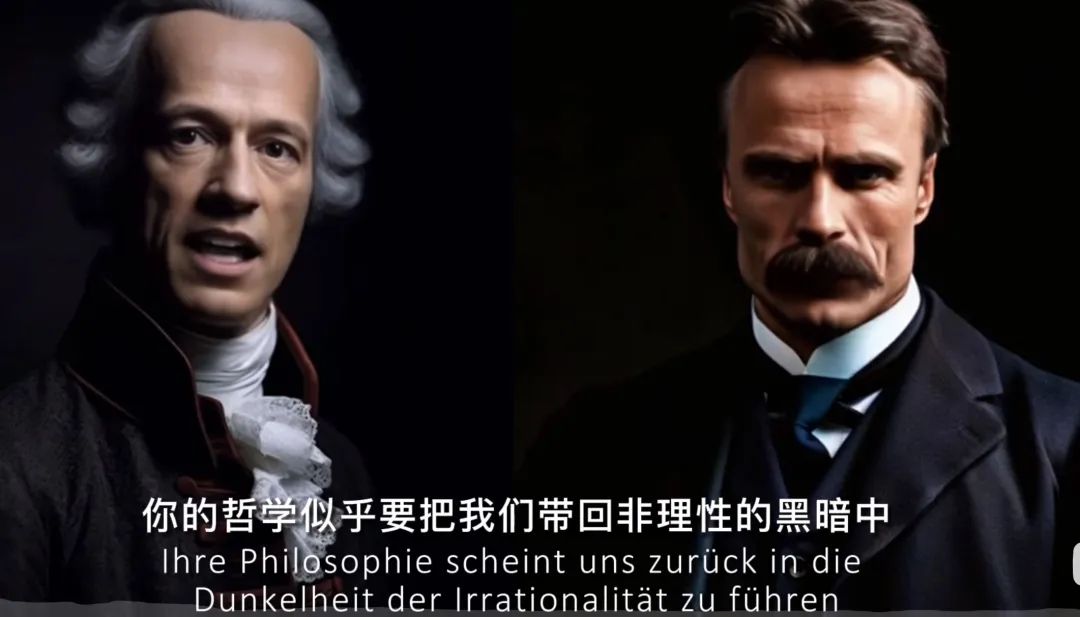

B站up主用GPT4模拟的尼采和康德对话 @闪闪的AI频道

总结一下,到这里为止,大语言模型的发展其实在意料之中。业内人士本来就预测说模型的素材库足够大,训练量足够多,就可能掌握整个语言的生成结构。预测中,人工智能不一定能做到这个地步,但做到了也不意外。

4►

AI还能创造哪些“意外”?

何君成:到目前为止,像ChatGPT这样的机器模型所体现出来的能力,哪些是业内意料之中的,哪些是意料之外的呢?

许东华:我们说到大语言模型,一般规模越大,效果就越好。比如说,它可以总结网络上一个词的所有定义,抽取一些共性,然后它可以用自己的语言讲出来。它的表述可以跟所有词典里的都不一样,但是又能把这个共性讲出来,这是它能够掌握的能力,这其实都在意料之内。

真正意料之外的进展是,语言模型大了,大到一定规模以后,它会涌现出来一些我们事先想象不到的性质。“涌现”这个词,《十堂极简人工智能课》里有过描述,就是说一些简单的规则能够组合出一些我们事先想象不到的现象。像鸟的飞行轨迹,每只鸟的飞行都遵循一个简单的规则,或者跟着前面的鸟飞,或者它自己领头往前飞。但是这些规则组合起来以后,你可以看到,那些鸟一会儿排成“人”字,一会儿排成“一”字,对人来说是一个很有趣的阵型,这种叫作“涌现”。大语言模型达到一定规模以后,它涌现出来的一个现象叫作思维链,chain-of-thought。指的是在对话里头,你给出一个大问题,模型能够把大问题分解成一系列容易解决的小问题并解决掉小问题,最后又把它合并起来,就解决了大问题。这个是我们事先预料不到的。

还有另外一个能力叫做情景学习,learning in context。你在跟模型对话的时候给它一个新任务,你自己想出来的一个游戏或者什么的,然后你给出几个例子,这个模型就能根据你给的例子推算出新任务的一般规律,然后你再跟他玩这个游戏,它就会跟你玩得有来有去,基本上都符合你要求的规则,这也是我们一般想象不到的。这些能力算不算语言某些更深层的结构的一种表现,这个可能会有争议,不知道有没有公论。但是我们事先是真的是没想到纯粹的语言模型能够自己涌现出这样的能力。

当然人类语言模型有很多东西跟生活经验直接有关。比如想象我们跟一个外星种族交流,那个种族不靠视觉获取信息,那么人类关于视觉现象的各种描绘、各种形容对他们来说没有意义。不过有的东西可以翻译一下,比如说“天是蓝的”这句话,可以翻译成:太阳的电磁辐射经过大气散射落到人的眼睛里头,电磁波以某个特定波段为主,那个波段人类语言叫作蓝色。这么长一段话用来翻译“天是蓝的”这四个字。

我刚才想到我们这些针对“蓝色”这个词关联的信息,说不定大语言模型里头也会有类似的表达。所以我问了一下ChatGPT怎样向一种没有视觉的外星生命翻译“天是蓝的”这句话。它的主要回答跟我刚才说的一段话差不多。不过它还多考虑了一步,说要是外星生命连电磁波是什么都不知道,那就要看那种生命有什么感官、有什么知觉,看能不能用那些词汇来打一些比方,这个考虑确实是比我更完整。

《E.T. 外星人》剧照

现在还有一些多模态模型的发展,我要解释一下,我们说的多模态就是不同媒介或数据,语言文字可以算一种模态,图像算一种模态,音频算一种模态。现在有一些多模态模型,把各种媒介合并在一起处理,把信号都有机结合起来,也许有一天可以让这些模型真正理解颜色是什么颜色,在什么情况下可以表达什么心情,诸如此类。那样的话,这些模型在创作的时候,说不定也可以产生类似人类通感那样的感觉,写一些比较神奇的诗句。我经常举一些例子,燃烧的雨丝、芬芳的月亮,这一类是通感句子,人类才会想出来,说不定以后机器也能想出来这些东西。

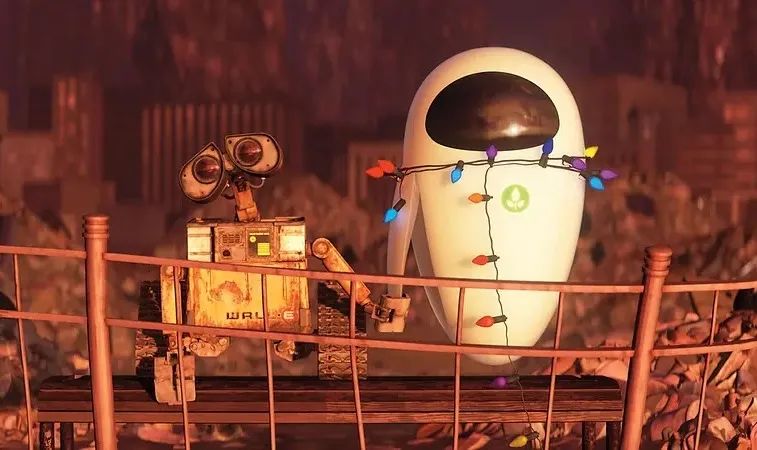

《机器人总动员》剧照

5►

人工智能时代,

文字工作者还有未来吗?

何君成:我们长期引以为傲的人类和人工智能最大的区别就是我们人类拥有创造力。但是许老师刚刚讲的这些例子,其实并没有为我们排除这样一种可能性——人工智能可能之后也可以通过自己的方式创造。所以现在我们怀着非常忐忑的心情想问最后一个问题,从系统的人工智能开发的角度来看,也从您作为一个译者,包括您自己也去做一些文字工作的角度来看,我们这样的工作是会被人工智能替代的吗?

陶泽慧:我们会根据自己的语言训练,包括一些其他的生活阅历去看待文字所传达的思想。但是ChatGPT包括大语言模型,它并不是从这样的角度,而是由它自己的一套文字预测体系去推演的。它不仅能够发现以我们自己的方式去发现的规律,它还能去探索很多其他的规律,其实它能做的事情是超乎我们想象的。我昨天晚上看到一个例子,讲一个人给了ChatGPT一段对话,向它提出了各种各样的写作建议。比如说你能不能把这段文字进行修饰,显示出这个人有很好的教育背景;比如说能不能把他的教育背景弱化一下,能不能往里面加一些适合的脏话,诸如此类。我们觉得那种训练有素的文字工作者,以及有很多生活经验的文字工作者才能完成的这种语言工作,ChatGPT是完全可以完成的,而且它可能真的做得惟妙惟肖。从这样的角度来说,我觉得我们再去设想ChatGPT能不能做文学翻译,这个至少在它未来的发展轨道里面,已经是它肯定能完成的一个事情。

但是后来我再去回想这个问题,我觉得我们谈论文学翻译也好,谈论ChatGPT也好,首先要理清一下概念。比如说我们观念中的文学翻译是什么,以及人工智能会怎样去接近我们观念中的这种文学翻译。在我看来文学翻译并不是说现在有一本文学的书,然后我们把它翻译出来。其实文学翻译,它有一种传统指向,是一种文化的积累。过去我们通过文学翻译能把它实现在单一的语言中,能够拥有一个经典文学的概念,这是过去的文学翻译做到的事情。

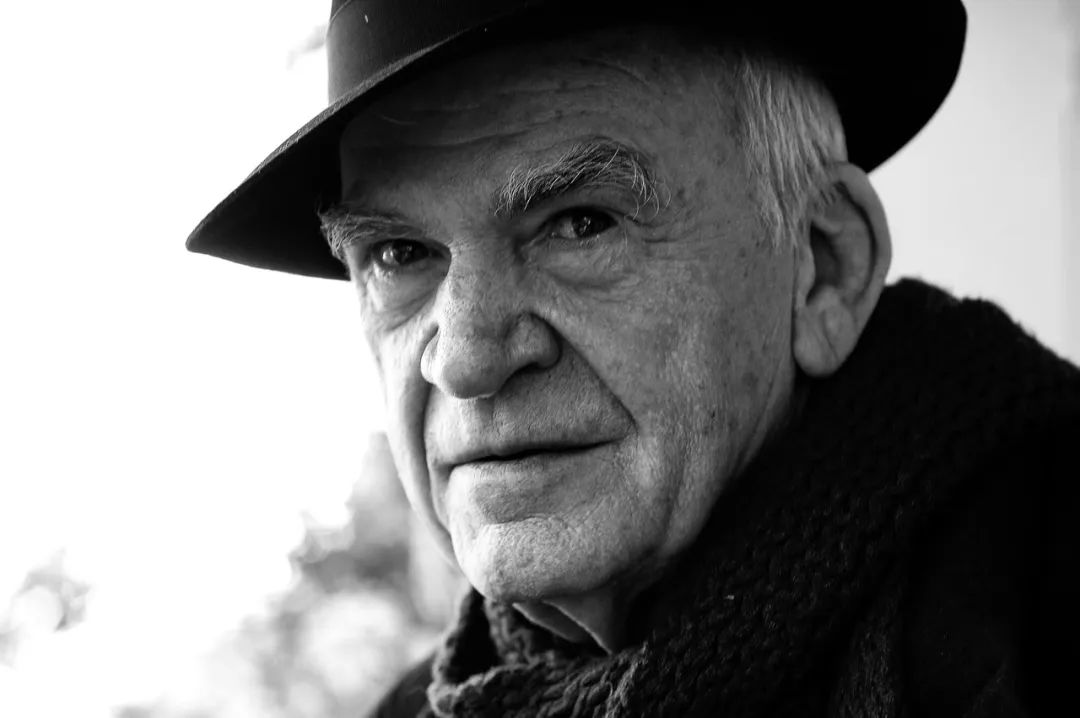

说到这里,我想起一个故事,讲一个中国人,他是一个文学爱好者,然后他去了法国生活,邂逅了一位法国的爱人。他们俩都是文学爱好者,但是随着关系的深入,他们发现彼此谈论的文学其实不是同一个东西。比如,他们都喜欢米兰德·昆德拉,结果中国人所谈论的其实是许均翻译出来的昆德拉,是《不能承受的生命之轻》,而他那个法国爱人其实谈的是昆德拉自己用法语写的那本书。

米兰·昆德拉

所以从我的观念来说,文学翻译本身是一个蛮庞大的指向过去的文本事件,而且它过去的积累是相对静态的。我们说的ChatGPT能不能取代文学翻译,这种可能性其实已经被包括在它的未来发展中。但我觉得文学翻译这样一件复杂的事情,它被人工智能入侵的话,不会是一个一蹴而就的过程,而是会经历很多阶段,我们这一代人可能不会在历史上迎来一个节点,说文学翻译从此完全被人工智能取代了。

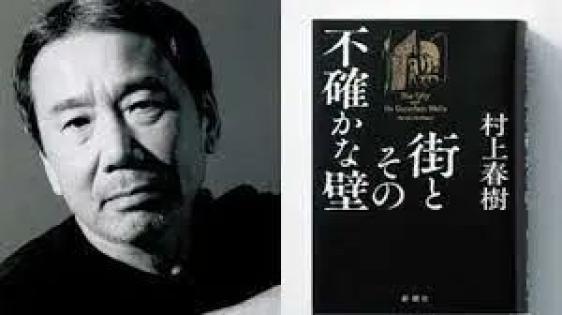

最近村上春树出了一本新的长篇小说《城市及其不确定的墙》。如果按照国内通常的翻译出版流程的话,我估计至少要半年到一年以上才会推出。但我猜测可能很快就会有人把它的文本塞给人工智能,然后在网上出现一个未经授权的版本,开始流传。以现在人工智能的能力,它翻译出来的版本会比文学译者差一点,但是它可以得到大面积的传播。所以我觉得在人工智能真正挑战文学翻译的信达雅之前——它未来肯定能够挑战——它可能会率先从时效性、传播性上具有一些非常独特的优势,比那种“慢工出细活”的文学翻译先行一步进入人们接受信息的场所,由此给传统文学翻译带来很大的挑战。

村上春树及新作《城市及其不确定的墙》

许东华:我可以先总结一下,人工智能做翻译,我们称之为机器翻译,其实从2017年transformer这个架构问世以后,机器翻译质量已经提高得非常多了。现在的这个趋势并不是从ChatGPT开始的,国外的翻译服务像Google Translate、DeepL这些东西在ChatGPT出现之前,都已经做得非常好了。ChatGPT翻译质量并没有比那些服务更高,它只是应用更广泛,但是光说翻译的话,Google Translate跟DeepL这些其实也都很好。

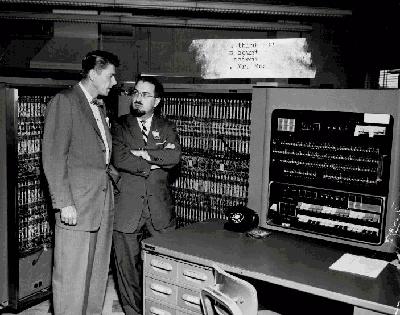

从人工智能发展史来看,人工智能的第一次春天和冬天都是因为机器翻译。最开始的时候,50年代,冷战刚开始的时候,东西方两大阵营都从对方收集了大量的情报资料,需要翻译成自己的语言,所以两边都投入大量的资金来做机器翻译,希望用计算机自动化地把这些资料翻译过来。我们这本书里也说到,刚开始科学家都非常乐观,觉得按照一些简单语言规则来翻译就行,结果折腾了十年发现翻译效果非常差,短期内看不到改善的希望,于是各国政府纷纷停止投资,人工智能也进入了第一次冬天。

1954年,IBM 701计算机将60个俄语句子翻成英文

这是历史上首次机器翻译

后来90年代人工智能有了第二次春天,那个时候机器翻译方法有一个范式的转换,从传统的基于语法规则的翻译,转换到基于例子或者基于统计学的翻译。所谓基于例子的翻译,它基本上的idea就是说我们平常可以收集到大量的已经有人类翻译的资料,然后把它们做一些模板化处理,比如说把人名、地名、数字这些明显经常会变化而且比较容易翻译的东西给它抽出来,剩下的东西放到数据库里头,作为句式翻译的模板。等新的句子来,如果看到是这个模板,我们就把那些人名、地名、数字新的翻译填进去,这个句子就翻译好了。这种方法对一些有限范围的翻译非常有效,像天气预报,翻来覆去是几十种句式,效果非常好,公司财报类似。但是更广泛的范围里头,应用效果很不好,因为人类的句式千变万化,而且同一个句子在不同语境里头可能要翻译成完全不同的样子,这跟上下文都有关,所以这个在广泛的翻译并不好。

90年代的电脑

现在是第三次春天,基于神经网络的大语言模型,它现在已经能够掌握人类生成语言结构,所以机器翻译水平比以前好得太多了。现在绝大多数翻译任务,我觉得是可以用机器翻译来打底,你不管用google translate或DeepL或者ChatGPT都好,用它们打一次底,然后人再来做一次润色,这样可能工作效率会比以前高很多,而且推往社会的速度也会快很多,我觉得出版社真的都可以考虑来这么做。

6►

人类不一定比得上机器,

但也不一定要跟机器比

何君成:按许老师的构想来看,未来在翻译上,以及在文学创作,甚至其他一些种类的创作上,人工智能的进步空间会大致存在于什么样的方向?

许东华:很多写作者有这样的体验:下笔之前也没有设想会写成什么样子,一旦动笔进入状态以后,一句一句巧妙的转折、精湛的比喻,人物说的话、做的事,都是自己从笔下或者键盘里头冒出来的。写完了再看一下,会觉得很意外,事先没有计划,但是这些文字自己活过来了,自己出现在那里。有的作家说,写作过程本身就是在享受创造的惊喜快感,因为每一秒都不知道下一秒会写出什么,有的作家说,先在脑中完整构思一遍的话,反而没有兴趣写下来,因为创造快感都享受完了。

古今中外很多作家都有类似的体验,说得意的作品都不是刻意写出来的,是老天爷借自己的手写出来的。这个体验仔细想一下,跟刚才说到的ChatGPT的工作方式也很类似。这些神经网络很复杂,我们并不知道它生成这些文字的时候会不会觉得是创造了快感,会不会有类似人类这样多巴胺带来的快感,我觉得可能有某种我们还不清楚的机制,在激励系统生成这样一些文字。

《爱,死亡和机器人》剧照

文学创作里头,国外有不少人在用ChatGPT类似的服务自己写小说了,有的小说已经开始卖了。说老实话,ChatGPT写的小说并不是特别好,但也并不是特别差,属于中庸。但过个五年十年,说不定可以写出非常精彩的小说。

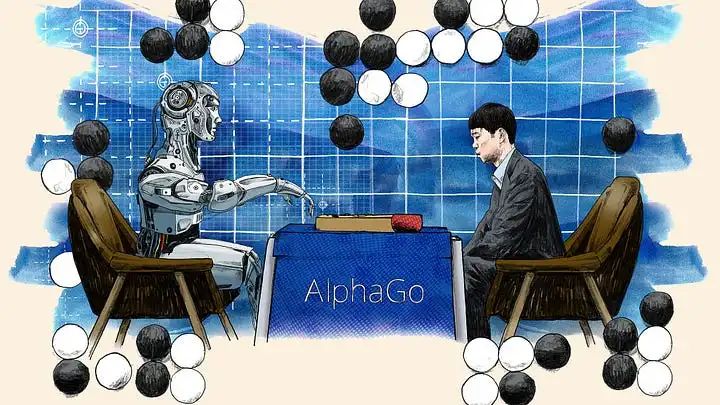

从我个人的角度来看,人类不一定比得上机器,但是不一定要去跟机器比。就像围棋,现在人类已经完全打不过机器了,但是人类自己还有比赛,自己还在磨练,可以跟机器学习怎样更好地下棋。不一定就是要比机器更好,但是自己要有一个动力往前进,人类才会继续往前发展,这是我的观点。

原标题:《AI如何向外星人翻译村上春树?》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2025 上海东方报业有限公司