- +1

Falcon碾压LLaMa?Huggingface排行引争议,有人自发测评,结论却相反

机器之心报道

编辑:蛋酱

大语言模型的竞争激烈,待在排行榜的第一位就要有成为众矢之的的觉悟。

说到开源的大语言模型,由 Meta 打造的 650 亿参数模型 LLaMA 曾经风头无两。

但这种一枝独秀的格局在上个月被打破了:5 月底,阿联酋阿布扎比的技术创新研究所(TII)开源了一个 400 亿参数的因果解码器模型「Falcon-40B」,据介绍,该模型在 RefinedWeb 的 1 万亿个 token 上进行了训练,并使用精选数据集增强。

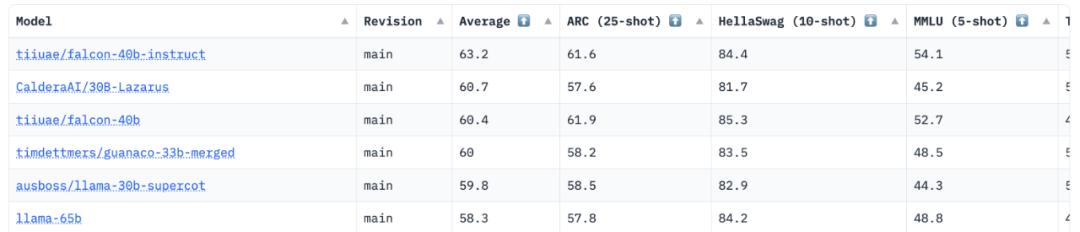

刚一发布,「Falcon-40B」就冲上了 Huggingface 的 OpenLLM 排行榜首位,「碾压」了参数规模 1.5 倍的「LLaMA-65B」,也优于 MPT、RedPajama 和StableLM 等开源大模型。

后来,Falcon-40B Instruct 版本占据了 Huggingface 的 OpenLLM 排行榜首位。目前,Falcon-40B 排在第三位,而 LLaMA-65B 已经掉到了第六位。

HuggingFace 排行榜:https://huggingface.co/spaces/HuggingFaceH4/open_llm_leaderboard

但 Falcon 模型自从开源的那一天起,就背负着众多的争议。

首先,从不差钱的阿联酋 TII 表示Falcon-40B 可以直接商用。这本来确实是难得的福利,但 Falcon-40B 遵循的协议是「TII Falcon LLM License」,有人。

与 Apache License 2.0 开源许可对比,二者的相似之处在于都授予使用、修改和分发许可作品的广泛许可,要求在分发中包含许可文本和归属,并具有责任限制、担保豁免权,而区别在于 TII Falcon LLM License 要求一旦达到收入门槛,需支付商业用途特许权使用费,而大多数开源许可不需要。TII Falcon LLM License 对如何发布或分发作品也有额外限制, 比如要求归属于「Falcon LLM technology from the Technology Innovation Institute」。此外,TII Falcon LLM License 对修改源代码和目标代码都有额外的要求,除非分发编译的模型。

总之,该许可允许开放使用和修改,但同时又保留了很多自有权利。

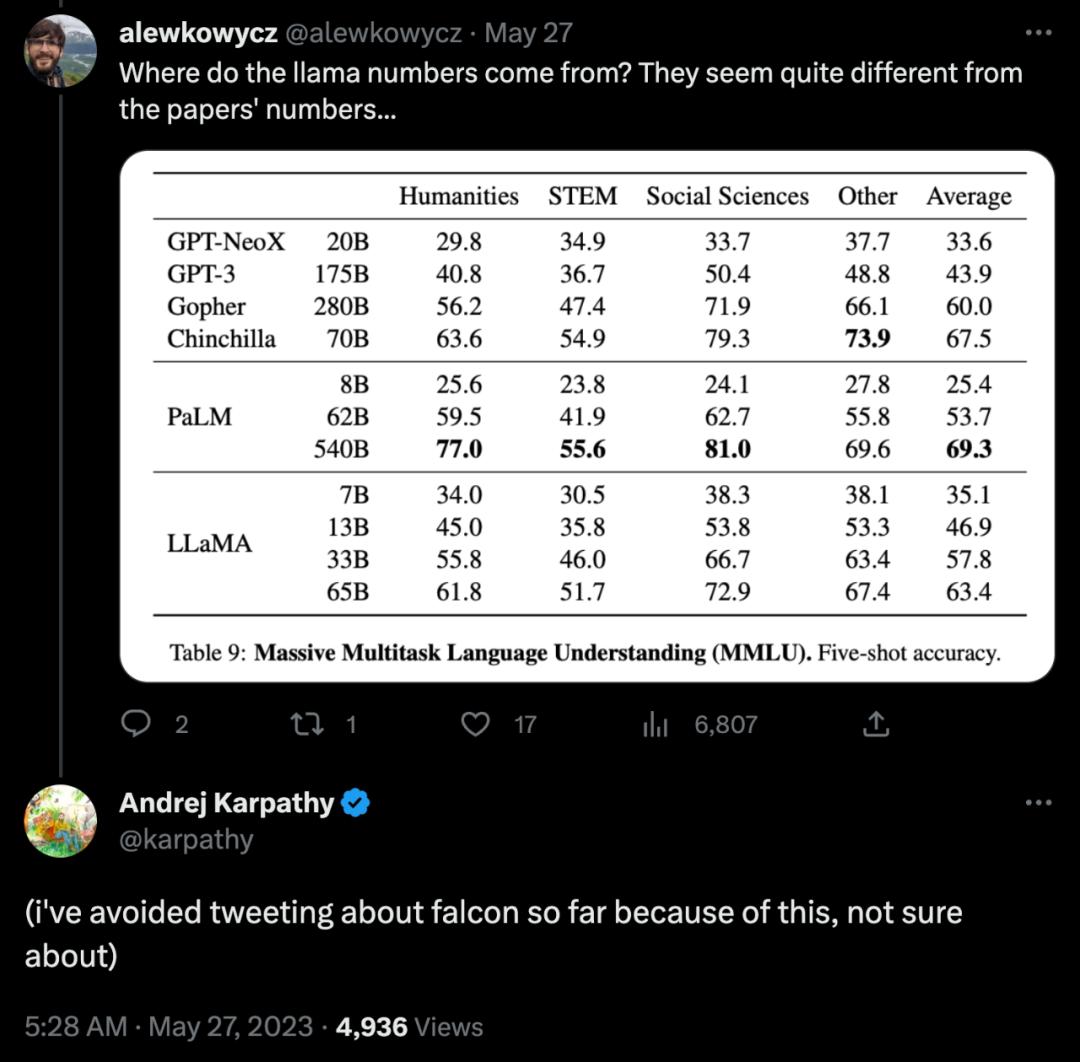

还有一个争议的点,为什么在 HuggingFace 的 Open LLM 排行榜上,LLaMA-65B 的 MMLU 这项分数是 48.8,明显低于官方数据 63.4?包括 Karpathy 本人,也因为这点疑惑而从未对 Falcon 模型给予任何评价。

图中数据来源:https://arxiv.org/pdf/2302.13971.pdf

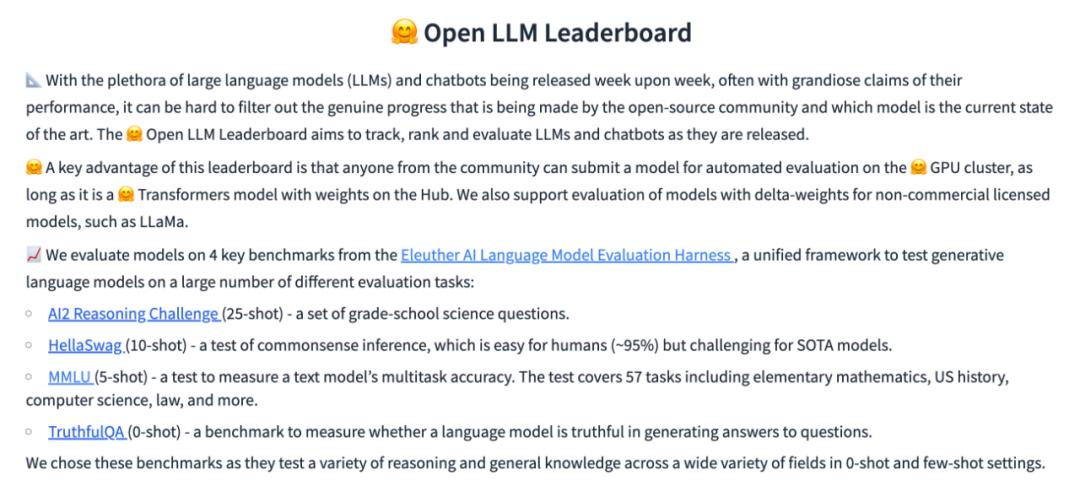

我们知道,HuggingFace 使用的是「Eleuther AI Language Model Evaluation Harness」语言模型评估基准。如此巨大的分数差异,会与 HuggingFace 平台使用的测评基准有关系吗?

个中原因为何,这很难评。但昨天,一项关于 LLaMA-65B 的测评获得了一波来自 AI 大神的「围观」。

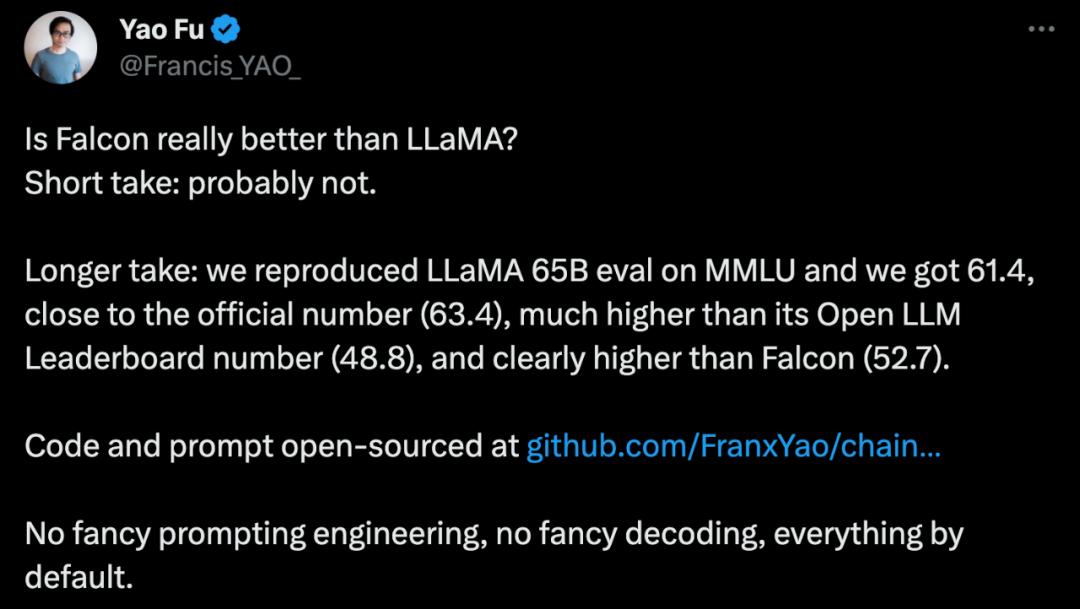

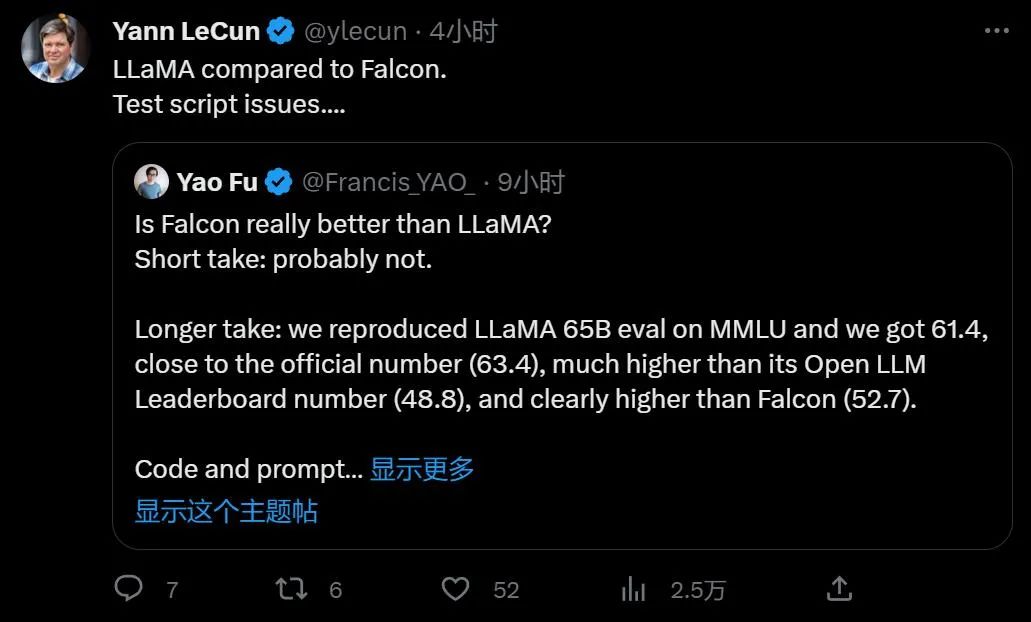

爱丁堡大学博士生符尧在推特上表示:「Falcon 真的比 LLaMA 好吗?简而言之:可能不会。」

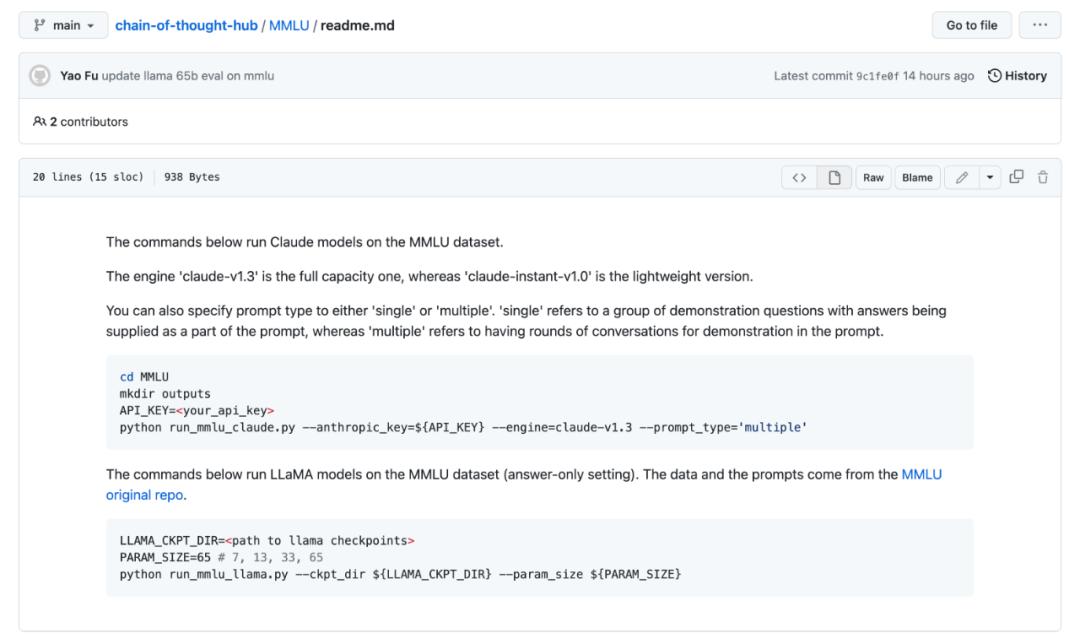

他们在 MMLU 上重现了 LLaMA 65B eval,得到的分数是 61.4,比较接近官方数字(63.4),明显高于其 Open LLM Leaderboard 分数 48.8,且远高于 Falcon-40B 的 Leaderboard 分数 52.7。

没有花哨的 prompt 工程和解码,一切都是在默认设置下进行的。

这次测评引起了大家的持续讨论,毕竟这也是大家持续疑惑的问题。

作为 Meta AI 的首席科学家,Yann LeCun 也转发了这条内容:「测试脚本问题……」

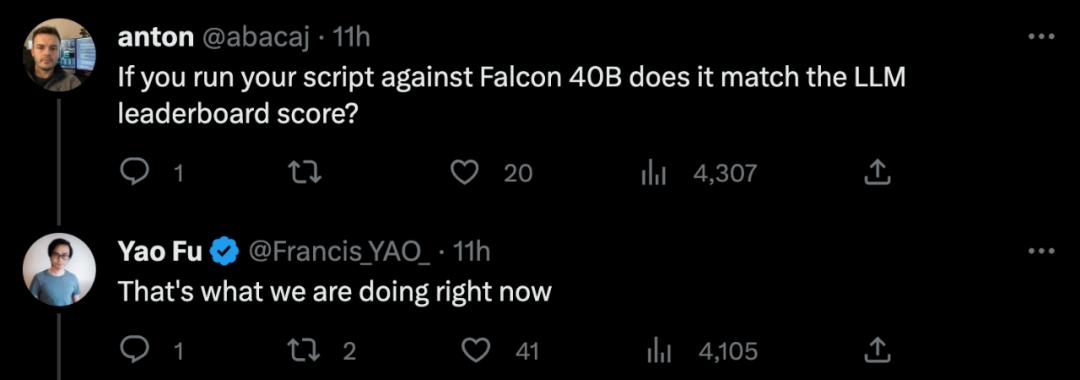

符尧本人表示,他们也正在测评 Falcon-40B,以验证其实际表现是否接近 52.7 的公开分数。

也有研究者表示:「很高兴看到开源社区能够快速自我纠正。对于 LLaMa 大于 10% 的 MMLU 分数差异,我也感到非常困惑。」

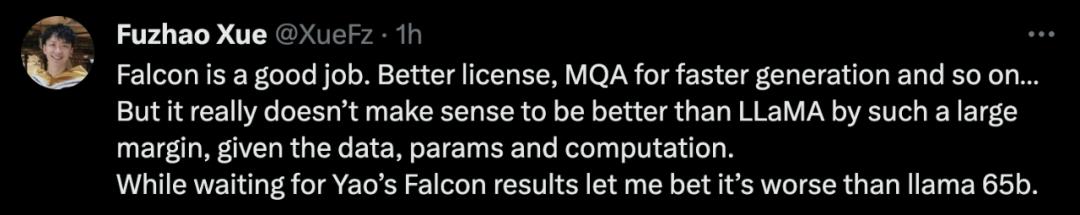

「Falcon 是一项好工作,更好的许可、更快生成的 MQA 等等…… 但考虑到数据、参数和计算,如此大幅优于 LLaMA 确实说不通。等待 Yao 的 Falcon 测评结果,我敢打赌它比 llama-65b 更差。」

这个故事至少启示了人们一个道理:尽管任何一个大模型的开源,对于学界和业界来说都是好消息。但与此同时,研究者们也需要更加谨慎。

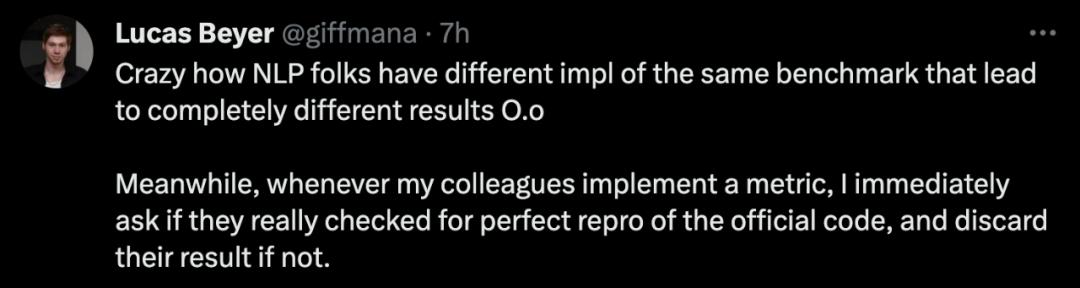

「每当我的同事实施一个指标时,我立即询问他们是否真的检查了官方代码的复现,如果没有,则丢弃他们的结果。」

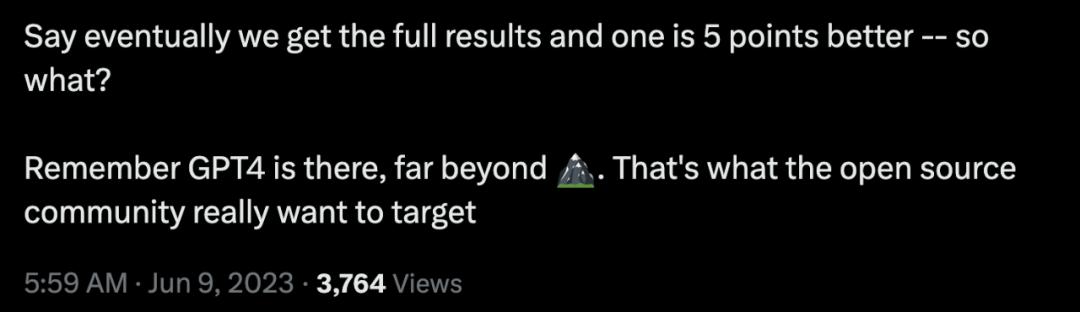

而且从现状来看,不管是 Falcon 还是 LLaMa,开源大语言模型的天花板都与 GPT-4 相距甚远,而 Falcon 和 LLaMa 都算是开源领域的重要力量,应该是一种良性竞争、共同进步的关系。

正如符尧在推特中指出的:「我们不打算在 LLaMA 和 Falcon 之间挑起战争 —— 两者都是伟大的开源模型,并为该领域做出了重大贡献!Falcon 还具有更简单的许可证优势,这也赋予了它强大的潜力!」

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com

原标题:《Falcon碾压LLaMa?Huggingface排行引争议,有人自发测评,结论却相反》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2024 上海东方报业有限公司