- +1

狙击谷歌搜索

下一代搜索引擎从根本上会基于不同的价值观(可控、可信赖),采取不同的商业模式。近十年人工智能技术的发展,使得小公司颠覆搜索巨头成为可能。

编译 | 吴昕

来源 | a16z

二十年来,搜索引擎设计或商业模式没有任何重大创新。

相信很多人早已厌倦充斥广告、商业泛滥的搜索,但更习惯于「忍忍就过去了」的将就。对于收割「羊群」注意力的商业手腕儿,哥伦比亚大学法学院教授 Tim Wu 在《注意力经济》一书中早已做了详尽描述。靠着广告费支撑着各种免费产品,占据数据撒哈拉的搜索巨头自然希望安于现状,但可供指望的「救星」又屈指可数。至少 5 或 10 年前想要建立一家搜索引擎公司与谷歌竞争,会非常困难,而且基本上不可能,因为需要数百人和大量训练数据。

不过最近几年,情况有所改变。就巨头们而言,随着各自赖以起家的核心业务走到巅峰,为了支持超高市值,他们开始迈入已知巨大市场,相互踩踏,比如搜索。

微软必应自然希望多一些市场份额。坐拥庞大电商平台和商家的亚马逊为什么不让用户直接从「自己花园」里开始搜索而一直要做谷歌的大客户?苹果直接高调挖走谷歌搜索和AI负责人。Siri基本上就是一个搜索引擎,通过回答用户提出的问题,可以帮苹果获得可观收益。虽然大打隐私牌的苹果似乎不想直接从广告挣钱,但用户还是难断定巨头们涉足搜索不过是另一轮「圈地运动」、收割流量的代名词。

在构建根本不同的东西、借由「创新者的窘境」式游戏来削弱谷歌搜索的路上,绝大多数创业公司被寄予希望,却总显得孤独寂寞。但也有例外。2021年,理查德·索切尔(Richard Socher)创立新公司 you.com, 进军搜索领域。这是一个无广告、保护隐私的搜索引擎。

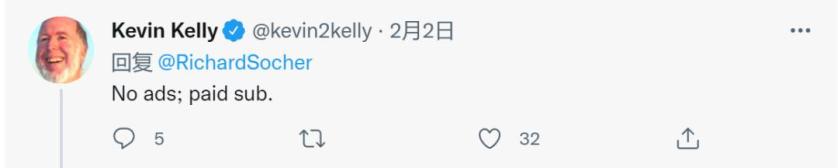

Socher 曾在推特上发问,具有什么样功能的搜索引擎会让你放弃谷歌? KK的回复是:没有广告;付费订阅。

一直关注人工智能领域的中国读者一定很熟悉这个名字。索切尔曾于2014 年创办了 MetaMind,后被 Salesforce 收购。索切尔的优秀履历也再添一份精彩:Salesforce 首席科学家和执行副总裁。

这位曾被世界经济论坛称为「人工智能神童之一」的后起之秀,于2014年在斯坦福大学计算机系获得博士学位,也是组建 ImageNet 团队成员之一,曾与 Chris Manning、吴恩达一起研究深度学习。不过,他并不眷恋纯粹的学术研究,毕业后即创业(成立 MetaMind )。他认为,拥有工程资源、让AI真正发挥作用可能更为重要。

自2012年深度学习革命爆发以来,理查德·索切尔就一直在参与其中,从事深度学习和摘要技术(Summarization)的研究。最近十年,人工智能领域发生了巨大的变化,特别是深度学习、无监督、半监督和迁移学习的激增使得像 you.com 这样的小公司可以与谷歌对抗,而充满杂乱广告链接、隐私体验欠佳的搜索引擎成为这些重要技术的最佳应用场景。索切尔认为,摘要技术不仅是信息时代的一项基础技术,也是注意力经济的一种解决方案。

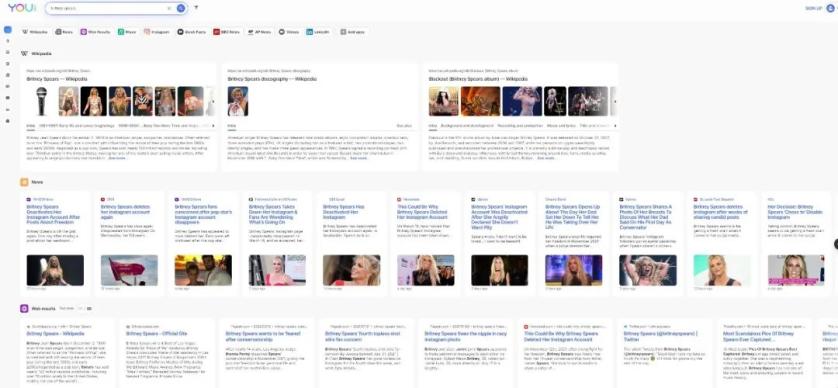

现在是启动新搜索引擎的最佳时机。他们利用自然语言处理(NLP)来理解理解查询意图,对搜索结果进行排名,并将人类语言语义解析为不同 API 的计算机语言。平台汇总了来自网络的信息,并且可以通过内置的搜索应用程序进行扩展,例如 Yelp 和 Twitter 的应用程序,用户无需离开结果页面即可完成搜索任务。让用户从多个不同角度探索一个主题。

输入Briney Spears ,you.com的页面显示。

索切尔希望建立一个真正以消费者为中心的搜索工具,该工具不依赖广告和对用户的了解。这个工具可以帮助你研究、总结网页信息,获得一些真正有价值的信息。

对工具可信赖、可控的强调,可能也与他这几年的工作体验有关。他承认,在与 Salesforce CEO Marc Benioff 的合作中学到不少。比如你可以赚到钱,也仍然可以与购买你产品的人建立信任。有意思的是,无论是当初创办MetaMind,还是后来创立 you.com ,都可以看到 Marc Benioff 的投资身影。

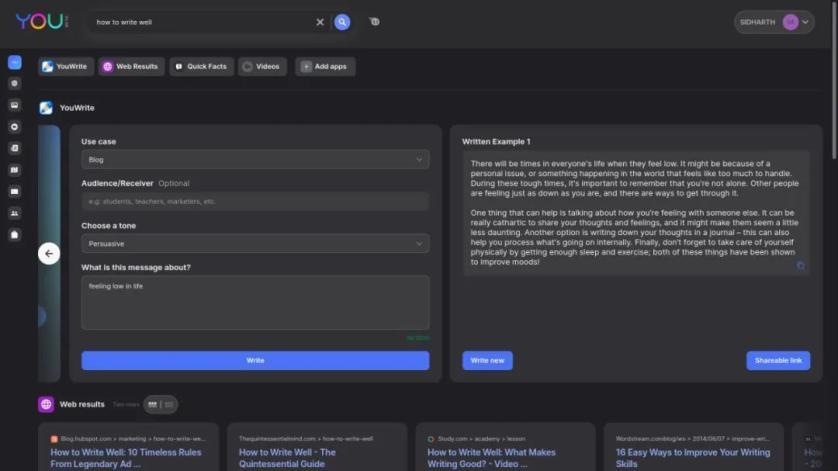

为了重新调整对搜索引擎的期望,You.com 还推出了一款与 OpenAI 合作构建的搜索应用程序 YouWrite,该应用程序会在出现提示时生成文本片段——甚至是文档。索切尔称其为「个人 AI 作家」。

YouWrite 根据提示生成文本

最近,索切尔接受了硅谷知名投资机构 a16z 合伙人、编辑 Derrick Harris 的采访。这次采访中,索切尔谈论了许多话题,包括过去十年中,人工智能初创公司情况发生了怎样的变化;在初创公司、企业和学术界做人工智能的区别,以及新的机器学习技术(如 Transformer 模型)如何使公司能够用过去所需资源的一小部分来构建先进的产品。其对下一代 AI 产品设计的可控性、可信赖元素的强调,均可在采访中找到阐述。以下是采访正文。

对于人工智能研究人员(学生和教授)来说,从学术界转到初创公司似乎是一个常见的做法,就像你做的那样。在今天,这两个世界有什么关键区别?

在学术界,人们仍在努力向人工智能可以产生影响的新领域前进,有些人希望在AGI(通用人工智能)方面取得进展。我认为有两个激动人心的新领域的例子,一个是蛋白质结构,也就是蛋白质或氨基酸序列方面,另一个是对经济学的影响。后者对世界来说非常重要,但 AI 的影响并没有我认为的那么大。

与此同时,对于初创公司来说,如果你有很多数据,流程也主要依赖于已经看到的数据,基本上可以说「我们知道它是如何运作的。」比如,你有一张放射图像,试着确定这骨头断了吗?或者有一个头部 CT 扫描,你要试着确定是否有颅内出血或脑出血?或者从病理图像中对不同种类的癌症进行分类。

所有这些应用的流程序列已经相对完善,即:识别问题并为其收集数据,在此基础上训练一个大型神经网络,然后优化和自动化流程中的部分或全部 。

有了这个经过验证的方法,你就能产生很大的影响。这与我们在电力方面所看到的情况类似:一旦掌握电力的基本原理,只要把它提供给一个以前只有油灯和火的城镇,就可以产生很大的影响。

这是可能的,部分是因为在过去的10年里已经发展出了许多有趣和重要的想法。以前不可能实现的事情,现在变得可能。比如让人工智能编写相当长的文本。一个主要的变化是,不仅仅是图像,所有的数据本质上都是矢量。所有东西都是一个数字列表,这个数字列表可以作为一个大型神经网络的输入,在上面训练任何你想训练的东西。

还有很多有趣和重要的算法改进(更不用说更多数据和更多计算性能了)。但是端到端学习( 深度学习的一个重要思想就是「端到端」学习方式,属表示学习的一种,也是这深度学习区别于其他机器学习算法的非常重要的一个方面。译者注)是一个非常重要的思想,它改变了很多事情。

从初创公司到大型企业的转变呢?这似乎是一把双刃剑,预算可能更多,但限制也更多……

两者在很多方面都不同,我只提两个例子。

如果AI工具初创发现很多公司都花费比如四分之一的开发人员围绕某一流程构建产品,而其中某部分或者环节要花费一到两个开发人员,他们就有可能在2B领域获得成功。这也是为什么许多AI工具初创都在帮助开发人员对付这些让人不太愉快的部分。

而要做到这一点,最好的方法是让客户仍然觉得自己在构建和控制人工智能,尽管实际上需要合作伙伴帮助标注数据、研究数据偏差。(比如)他们首先要收集数据,通过 Huggingface(一家在 NLP 社区做出杰出贡献的纽约创业公司,提供了大量预训练模型和代码等资源——译者注)实现模型,借助 Weights &Biases ( 一个可帮助数据科学家跟踪他们的模型、数据集、系统信息等的平台——译者注)训练模型时扩展模型分析,并通过 ZenML (一种可扩展的机器学习框架——译者注)部署模型。

(算下来)虽然依赖10-15个外部支援,但相对于围绕某个特定AI模型重复造轮子来说,这样能够更快、更可扩展、更准确地训练 AI。找到类似各种各样已经存在但又缺乏高度专业性、需要专业团队聚焦的某些特定方面或者环节,是创业公司的一大乐事。

但在像 Salesforce 这样的大公司,你主要考虑的是什么能够真正改变许多不同客户的需求。如何帮助那些已经在您系统中的客户使用他们的数据集,以一种他们仍然觉得(实际上也确实)拥有控制权的方式?这一点很重要,因为在 Salesforce,信任是我们的第一价值。你不能只是拿每个人的数据,然后对其进行训练,因为他们拥有自己的数据,而且他们为存储付费。因此,你还需要与客户合作,努力让他们的人工智能项目起步。

所以,企业软件供应商担心的是客户支付了很多钱,你就不能以试验新功能的名义来破坏工作?

这是部分原因。但可能更重要的是,你必须确保它是可信、易于使用,并且可以跨越所有这些不同的用例,而且服务的成本仍然相对较低。如果是一个像 Salesforce这样的平台公司,你也不能只建立一个分类器,还必须让所有客户建立他们自己的分类器,这也伴随着各种有趣和困难的技术挑战。

企业预算如何改变公司处境?

最大的区别是,当公司规模越来越大时,就可以而且应该进一步展望未来,做更多有趣的研究工作,这实际上与学术界有更大的重叠。因为你可能会在两三年内被打乱,而你又有足够的空间去思考四五年后的未来。所以需要预测一下接下来会发生什么。

因此,作为一家大公司的 AI 研究人员,你可以奢侈地去思考和构建一些东西,而在初创公司,你需要构建人们现在想要的东西,它还需要非常好,并在合理的时间范围内发货。这就是最大的不同——绝大多数初创公司都在从事应用,应用程序和人工智能,而不是基础研究;大公司可以两者兼得。

当你谈论 B2B 初创时,提到的很多东西,我们可以称之为横向应用( horizontal applications )。为什么你认为这些在今天被证明是成功的,而情况并非总是如此?

总有一些非常有用的垂直 AI 应用程序,但有一个短暂的阶段,我们认为横向的平台可能会起作用。其实,早期的人工智能平台初创公司就承担了太多不同的任务。

例如,我们在 MetaMind 构建了一些技术,你可以将一些文本或图像拖放到 Web 浏览器,拥有一个完全可扩展的系统来对这些文档进行分类。某种程度上,这确实有些古早,因为这都发生在前 TensorFlow 、 PyTorch 时代。你必须从头实现所有这些神经网络及其细节,也几乎没有什么开发工具。现在,情况已经发生了显著变化。

我们在 MetaMind 中构建了所有这些东西——标注、错误分析、部署、建模、如何训练模型分析。有趣的是,如果每个部分都有一个专注于此的独立公司,现在他们中的每一家都比 MetaMind 更值钱。

我认为,大多数公司和开发人员都希望自己通盘掌控 AI,但他们可以放弃其中独立的较小部分,如果编写这部分代码实际上并不那么令人兴奋。所以,需要找到一种有趣的方式,在乐趣和让每个人都感到掌控感之间找到平衡。既然初创公司负责提供机器学习工具,你就不能剥夺太多用户的掌控感。

网络和模型的进化如何改变了人们对创办公司或构建人工智能产品的看法?

我实际上并不认为特定模型对如何创办公司有很大的改变。但我认为,某些模型目前更高效,因为它们能更好地处理我们拥有的硬件。我们并不真正受大脑、理论或原则启发——而是受 GPU 启发。我们的灵感主要来自在 GPU 上运行良好的东西。当前流行的模型 Transformers,对于 GPU 来说就非常有效,可以非常有效地进行训练。

对于硬件初创公司来说,这确实改变了一些事情。他们看着英伟达和其他一些大公司,然后说「嗯,必须有某种方法来分一杯羹。」 我们也因此会看到一些创新。(不过)与此同时,他们真的很难扩展,因为对于绝大多数用例来说,他们的特殊硬件必须出现在大型云提供商之一当中。

当然,整个 AI 开发堆栈在过去 8 年中已经成熟了很多。遥想当年,如果你希望它更快,就必须从头开始用 C++ 实现所有内容,这非常慢。人们需要很长时间才能加快速度和学习。而现在,所有这些复杂性都可以被抽象出来,你可以使用我们之前讨论过的产品,这使得构建高质量的人工智能系统变得更快、更方便、更容易。

但是算法的进步确实让局面有很大不同,对吧?例如,you.com在隐私方面很重要,这也是你可以优先考虑用更少数据做更多事情的原因之一。

这是一个很好的问题,而且绝对正确。如果 5 或 10 年前想要建立一家搜索引擎公司与 Google 竞争,会非常困难,而且基本上不可能,因为需要数百人和大量训练数据来构建我们正在建立的排名系统。现在,一个非常小的团队(尽管小,但非常聪明也很有能力)就能构建一个排名系统,对你在搜索引擎中输入的任意意图和查询进行排名,并提供正确的应用程序、资源集合。

像 you.com 这样的小公司可以与谷歌这样的大公司竞争,唯一的原因在于我们在人工智能方面看到了进步,特别是涉及无监督学习和迁移学习时。你可以在维基百科、Common Crawl(一个非营利组织,利用自己的网络爬虫收集了十亿级别的网页数据,任何人都可以免费访问,研究人员和企业家就可以在谷歌级别的数据上进行新的尝试和探索,新的创业机会也油然而生。——译者注) 以及所有你能找到的网络文本上训练非常大的神经网络。(也要记住,并不是所有网络上的东西都能用于训练很好的人工智能)。

我们可以利用这些资源训练无监督模型,比如预测句子中的下一个单词。「我去了南加州,很享受……」,如果对语言和世界很了解,就会预测到下一个词可能是「海滩」、「沙漠」,或者任何在南加州能够享受到的东西。但预测的前提是你必须具备大量的知识。而训练一个模型来预测几百万甚至几十亿单词序列的下一个单词,一开始也需要整合所有这些背景知识。

这就涉及无监督学习,没有人坐在那里给你标记好下一个单词是什么。只有维基百科,模型可以从里面学到很多正确排序的单词表达。

这个想法很牛逼,你只需根据任务目标对大型 NLP 模型稍加修改即可让其完成任务。它能超越特定、小规模标记数据,进行更为广泛的泛化,因为他们拥有知识感;他们知道「我附近最好的泰国餐馆」与「我所在地区最好的东南亚餐馆」非常相似,尽管训练数据中从未有过这个特定的短语,但我们的神经网络和排名系统可以做到这一点,因为它们知道这些短语是相似的。

说到搜索,我注意到 you.com 很重要的一点,就是总结(搜索)结果的方式,这是源自用户页面设计的需求,张三李四随时随地都可以做到?还是得益于机器学习技术的进步才能以这种方式处理搜索结果?

虽然听起来不那么酷,但摘要实际上是最难的人工智能任务之一,尤其是在自然语言处理中,原因有很多也有趣。原因之一,摘要是个非常个性化的任务,我知道你(摘要的接收者)知道什么,我就可以为你提供更好、更准确的摘要结果。

比如,如果你不知道什么是词向量,你就很难理解 Transformers( Google 的团队在 2017 年提出的一种 NLP 经典模型,现在比较火热的 Bert 也是基于 Transformer。——译者注)。为此,你首先需要了解词向量的基础知识。如果你已经知道什么是 transformers,那摘要就会变得很简洁,比如,「他们正在用语言建模而不是机器翻译来训练它,这是一个更好的目标函数。」

而且我认为摘要是一个重要的技术趋势,未来几年,随着你的时间越来越宝贵,需要简单工具帮助你完成一些工作,越来越多的人会在喜欢上它,而不是被那些卖广告的公司所吸引,他们不想帮助你完成工作,而是帮助你查看更多内容,以便展示更多广告。

我们不赞同这一点,摘要(技术)是其中很重要的一部分,它可以帮助用户少做些搜索多完成工作,或者少搜索,多写些代码。我们的应用程序包含有代码片段,你可以复制和粘贴,通常都是正确的摘要。如果正在搜索「如何在 Python 中对字典排序」,答案不是一长串文本,而只是一个代码片段。或者,当我们向您展示一篇论文时,有一个指向实现该论文的开源版本的 GitHub 存储库的链接。

我认为,下一代搜索引擎从根本上是基于不同的价值观,也是不同的商业模式。

鉴于我们已经讨论过的所有进展,对于那些希望立即进入 AI 领域的人,你有什么建议?要做的事情或需要学习的技能是什么?

这在很大程度上取决于他们的年龄、技能、时间投入以及想进入的领域。如果你还年轻,未来也想以此为业,你仍然需要学习编程基础、数学、统计学和一些概率知识,很多线性代数等等。

如果你已经上班,也想进入这个领域,有大量令人兴奋的新在线课程、视频和平台,供你深入学习。现在有这么多的材料,连斯坦福 CS224 NLP 课程也有,这就是我鼓励人们去做的事情。

一旦完成了这些,接下来就是要动手实践了,写程序或者玩模型,顺便想想目前还有哪些流程或者任务是靠手动的,或者处在半机械半人工状态?你能做些与众不同的东西,尝试自动化它们吗?

较之真正理解这些模型是如何工作,仅满足于使用云API和不同水平的抽象化(abstraction)能让你走多远?

这完全取决于你的背景。如果受过高等教育,有数学方面的背景,你可以很快掌握一些基础知识,直接跳到构建真实模型的阶段,而不需要从头开始。不过,越依赖抽象化,可能就越难以做一些真正有创造性的工作,也很难理解如何修复错误,解决性能问题。

但在许多用例中,您也没必要创新。比如,你可能只是想要一个自动喷水灭火系统,因此,你只想回答:「有人站在这里吗?是还是不是。」 如果没有,请打开自动喷水灭火系统,不需要为此发明任何创新性的东西,只需要执行所有正确的标准步骤并为图像分类器使用好的工具。

但是,抽象化仍然存在漏洞,也并不完美。因此,应用程序越重要——它对你的公司、受影响的用户或你的职业越重要——你就越希望拥有深入了解这些系统的专家,知道如何修复某些错误或性能问题的专家,以及思考人工智能系统如何影响人们的人。只有这样,你才能真正以安全、最大限度发挥积极影响的方式自动化某些流程。

参考链接:

https://future.a16z.com/a-decade-of-deep-learning-ai-startup/

原标题:《狙击谷歌搜索》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2025 上海东方报业有限公司