- +1

患者痛不欲生,但AI说:别给她开止疼药

博雯 发自 凹非寺

量子位 报道 | 公众号 QbitAI

因为严重痛经入院,在医嘱下注射阿片类药物(Opioid)以缓解痛苦。

结果入院四天后,就突然被AI告知:

你将不会再接受任何阿片类药物。

然后就抱着尚未被消除的病痛,立即“被出院”了。

这就是2020年7月份,32岁的Kathryn所遭遇的情况。

而更让她无法理解的是,两周后,长期保持联系的妇科医生突然又向她声明:要终止他们之间的关系。

一番查证之后,Kathryn最终发现——

源头竟来自她的两只宠物狗?

宠物狗生病让主人被禁止买药

其实,在住院期间,Kathryn在被告知“不能再使用阿片类药物”时,工作人员同时也表示:

你完全没有意识到自己的图表中有多高的分数。

当时的Kathryn并不明白“图表”和“分数”是什么意思。

而两周后她的医生送来的终止关系的声明中,又有这样一段描述:

(关系的终止)来自NarxCare数据库中的一份报告。

或许这里提到的NarxCare和之前所说的“图表分数”有关?

Kathryn和她周围的人都没有听过这个名字,于是她马上去Google了一下:

原来,这是一个面向医生、药店和医院的分析工具和护理管理平台。

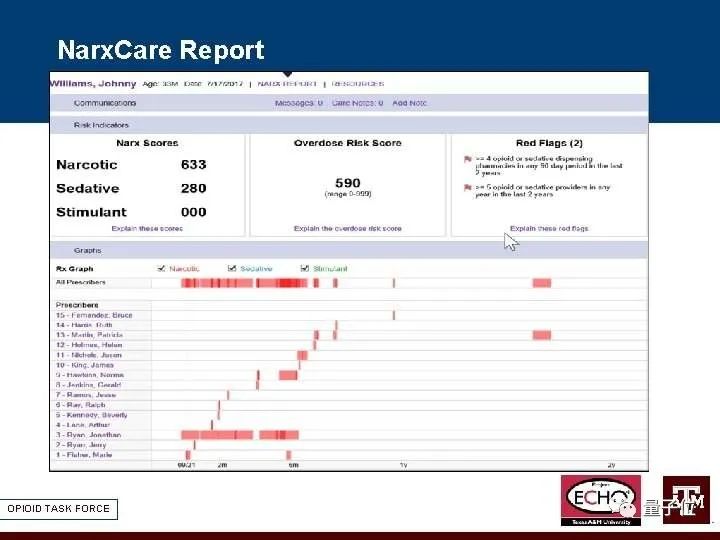

NarxCare可以利用AI算法对病患的处方药数据进行统计和分析,最终得到一个风险报告。

它主要使用来自国家药品登记处的数据。

除此之外,医疗索赔数据、电子健康记录、 EMS 数据和刑事司法数据也在使用范围之内。

NarxCare会通过机器学习算法对这些数据进行统计和分析,最终得到一个预测模型。

根据这一模型,每位患者都会得到一个属于自己的的“处方药使用风险评估报告”:

如果评分过高,就有可能被认为是有药物滥用情况,从而被拒绝出售相关处方药。

但这仍然不能解决Kathryn的疑惑:

她所患有的子宫内膜异位症导致了常年的生理病痛,因此她确实有长期服用阿片类药物(如扑热息痛)的习惯。

但这一切都是在医生指导下所开的处方药啊,怎么突然就被叫停了?

在与各种论坛上的慢性疼痛病患者的交流之后,Kathryn最终找到了这场意外的源头。

而结果让她感到无比离奇——

原来,Kathryn的两只宠物狗,都曾因疾病而服用过大量的阿片类药物、苯二氮卓类药物,甚至巴比妥类药物:

由于代谢原因,狗狗们所服用的剂量会高出人类。

而买药的全部流程挂的都是主人,也就是Kathryn的名字。

因此,Kathryn去过的药店数量、去医院的路程,以及她收到的处方药组合,全都被NarxCare记录了下来。

她的宠物狗们的服药经历,全都算到了她的头上。

美国处方药监控项目

这场非常荒谬的意外,或许是由于平台算法的缺陷所导致的。

不过让Kathryn更在意的是另外一点:

这样一个暗中收集处方药数据的项目,她和身边的大多数人从来都没听过。

谁允许的?

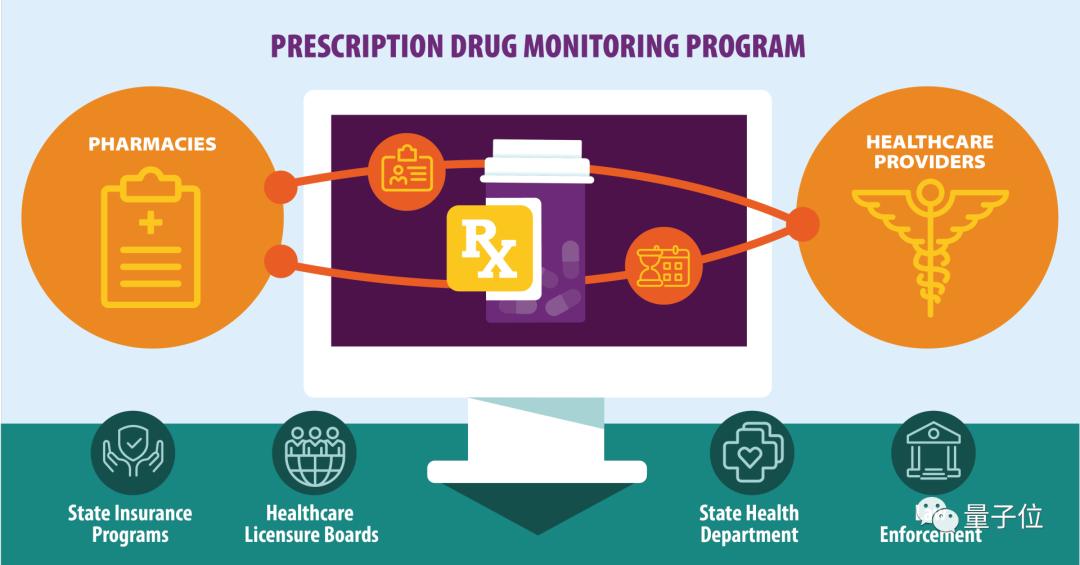

其实,这是来自过去20年内,美国已投入了数十亿美元的处方药监控项目:

司法部一直在致力于开发和维护州级处方药数据库。

他们希望通过这一电子登记系统实时跟踪某些受管制药物的药方,密切关注制药市场。

现在,几乎美国的所有洲都有一个这样的处方药监控项目(PDMP)。

而在过去的几年里,一家名为Appriss的公司慢慢主导了这些州处方数据库的管理。

NarxCare,就是Appriss公司旗下的产品。

Appriss希望通过NarxCare所产生的报告来帮助处理药物滥用情况,并辅助医生进行更好的诊断决策。

在目前的美国,几乎每个州都会要求医生和药剂师在开具处方药的同时,咨询和参考NarxCare中的医疗信息,否则就有可能被吊销执照。

而对于Kathryn这样的例子,Appriss则表示:

宠物狗提高了主人的评分,这是一个非常罕见的例子。

但不论这是怎样的一个卡夫卡式的发展,对于现在的Kathryn来说,每次进入药店时,总能有人看到她过去的那些“图标和分数”。

她对此表示:

这让我感到我走入的不是药店,而是宗教审判所。

不公开的专利算法

而像是Kathryn这样的例子并不少见。

她在慢性疼痛患者论坛中,就曾遇到一位拥有相似经历的女士。

在对医生进行自我介绍之前,就先被要求披露自己为什么长期服用阿片类药物。

回答了自己患有PTSD后,还被要求进一步解释精神创伤的原因。

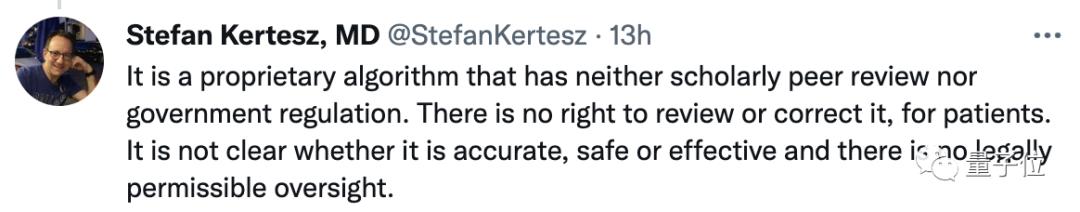

而目前NarxCare并不需要获得FDA的批准,这也让一些医学专家提出了质疑:

它(NarxCare)是一种专有的算法,既没有学术界的同行评审,也没有政府监管。

NarxCare用于过量风险评估的算法并不对外公开。

不过根据官网的一些已有的资料,我们可以了解它们大致的思路:

在得到来自处方药监控项目的大量数据,并开发了一个大的变量集后,再将数据分解为一个训练集和一个测试集。

有了训练数据之后,算法就开始将服药过量和未服药过量的模式进行对比。

比如,如果某位病患拥有同一医生开出的三张阿片类处方药,那么他的药物滥用风险就远远低于三位不同医生开出处方药的病患。

在这种重复的对比和学习中,最终就得到了一个用于评估病患风险的预测模型。

这一算法近年来在生命的多个领域得到了广泛应用。

比如,常常被用来预测哪些病人最有可能从特定的治疗中受益,并估计ICU病人出院后恶化或死亡的可能性。

但也就像很多人说的那样,NarxCare并不透明,没有办法从底层去检查它们是否存在错误或偏见:

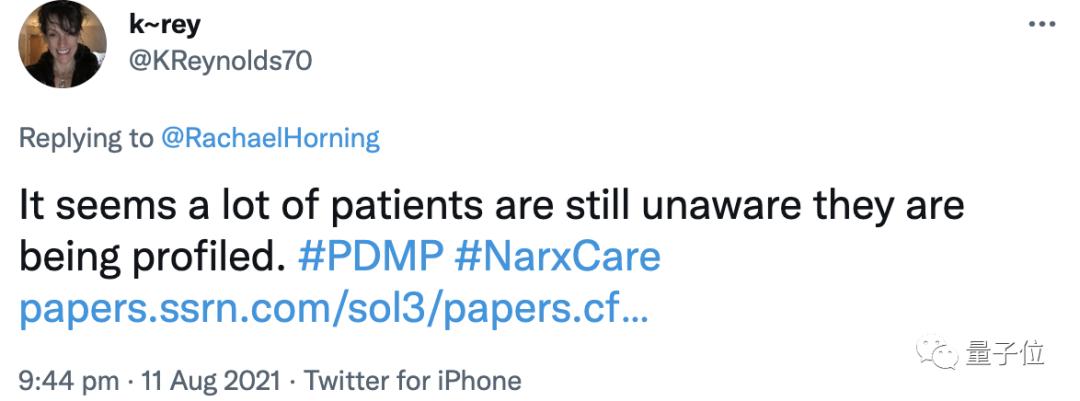

有很多病人并没有意识到他们正在被测量分析。

甚至不仅是病患,连使用这一辅助临床决策系统的医生也无法完全知晓它的原理。

就像是亲身体会的Kathryn所说的那样:

对于大多数美国人来说,这是一个秘密的信用评分系统。

参考链接:

[1]https://www.wired.com/story/opioid-drug-addiction-algorithm-chronic-pain/

[2]https://twitter.com/Annaleen/status/1425493523076304898

NarxCare官网:

https://apprisshealth.com/solutions/narxcare/

— 完 —

本文系网易新闻•网易号特色内容激励计划签约账号【量子位】原创内容,未经账号授权,禁止随意转载。

原标题:《患者痛不欲生,但AI说:别给她开止疼药》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2025 上海东方报业有限公司